5分钟阅读

普大喜奔!Kontext dev开源,这份指南看看!

前言

关于Kontext,我们已经写过几期的使用技巧,本文就不再赘述其应用场景和使用方法了。感兴趣可以回顾一下:

- 【AI辅助设计】就在昨晚!FLUX新增重磅模型Kontext

- 【AI辅助设计】FLUX.1 Kontext的几个辅助设计场景

- 【AI辅助设计】如何让FLUX.1 Kontext指哪打哪?我尝试了这个方法。

- 【AI辅助设计】Kontext+FusionX低成本labubu动画工作流

昨天晚上黑色森林开源了Kontext 的dev版本,还是那个赛博佛祖!👍 开源模型嘛,当然是在ComfyUI中使用最为合理。相信网络上已经有很多教程了,今天我简单介绍一下使用方法,重点是带大家重新回顾一下这个模型,包括其使用的技巧以及前世今生!

Kontext 使用方法

这里主要介绍ComfyUI中的使用。

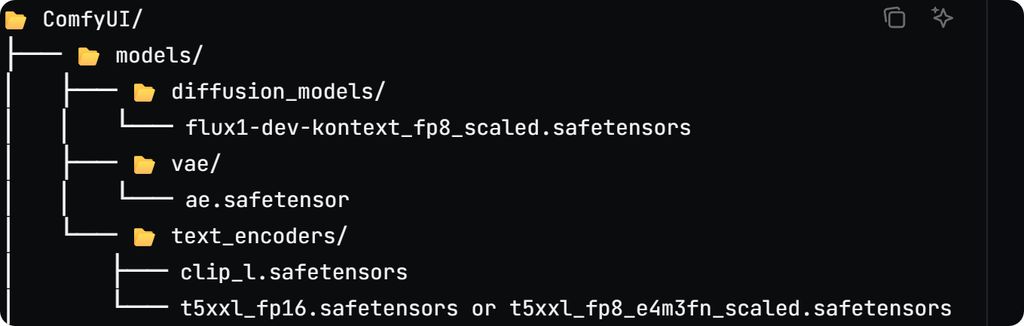

下载模型

- flux1-dev-kontext_fp8_scaled.safetensors:

https://huggingface.co/Comfy-Org/flux1-kontext-dev_ComfyUI/resolve/main/split_files/diffusion_models/flux1-dev-kontext_fp8_scaled.safetensors - ae.safetensors、clip_l.safetensors、t5xxl_fp16.safetensors之前如果使用flux模型的,可以不用下载的。

目录如下:

工作流

我就截图了,网上资料也很多。

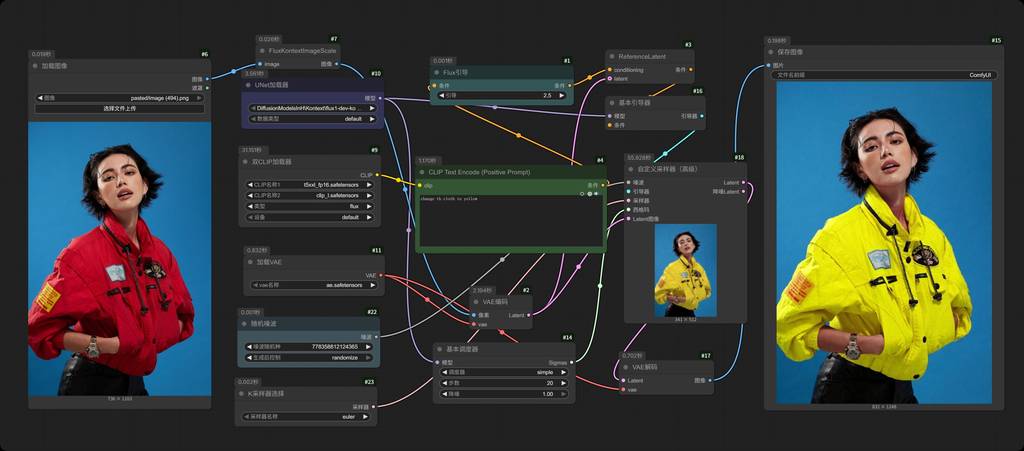

单图流

这是基于官方的ComfyUI工作流改的,适合做单图的改图用。

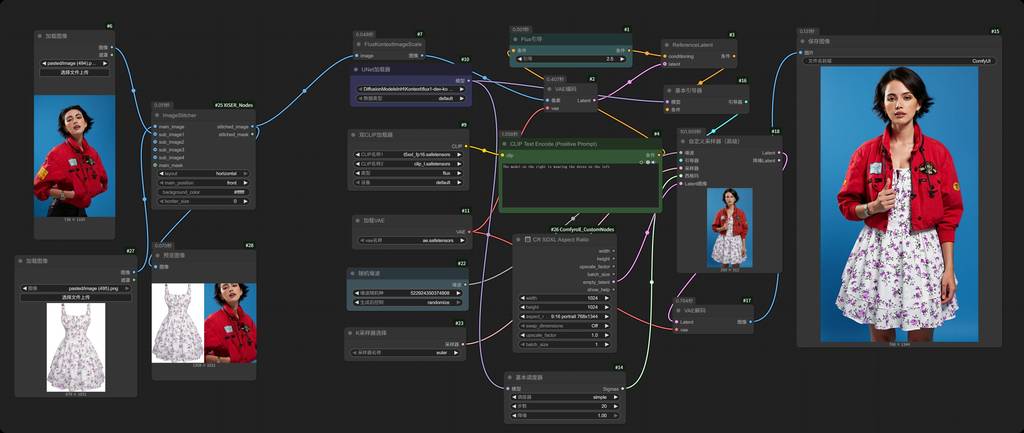

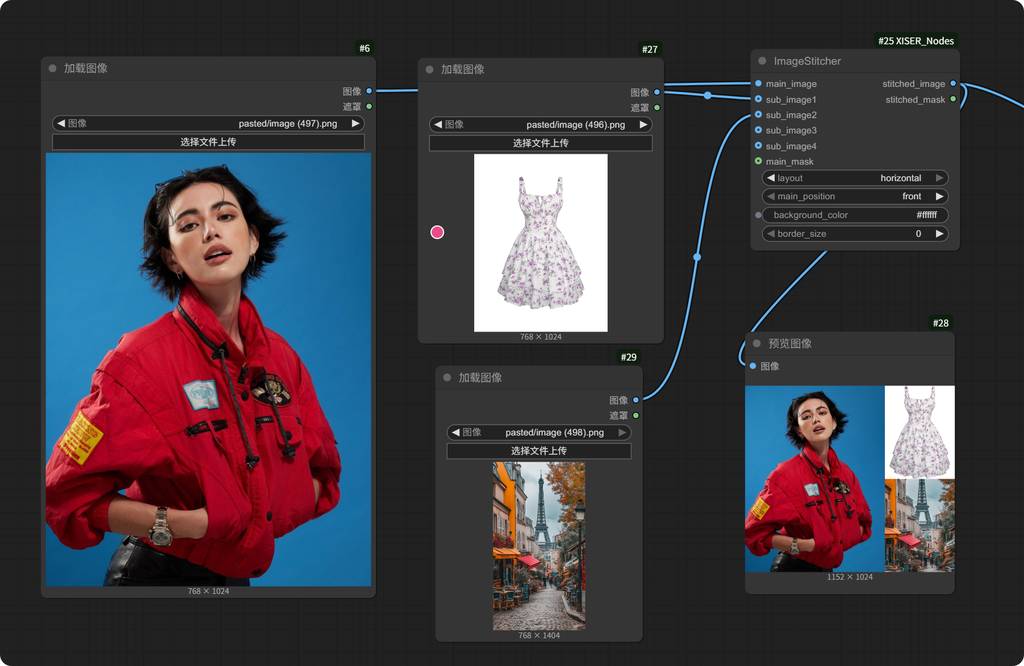

双图流

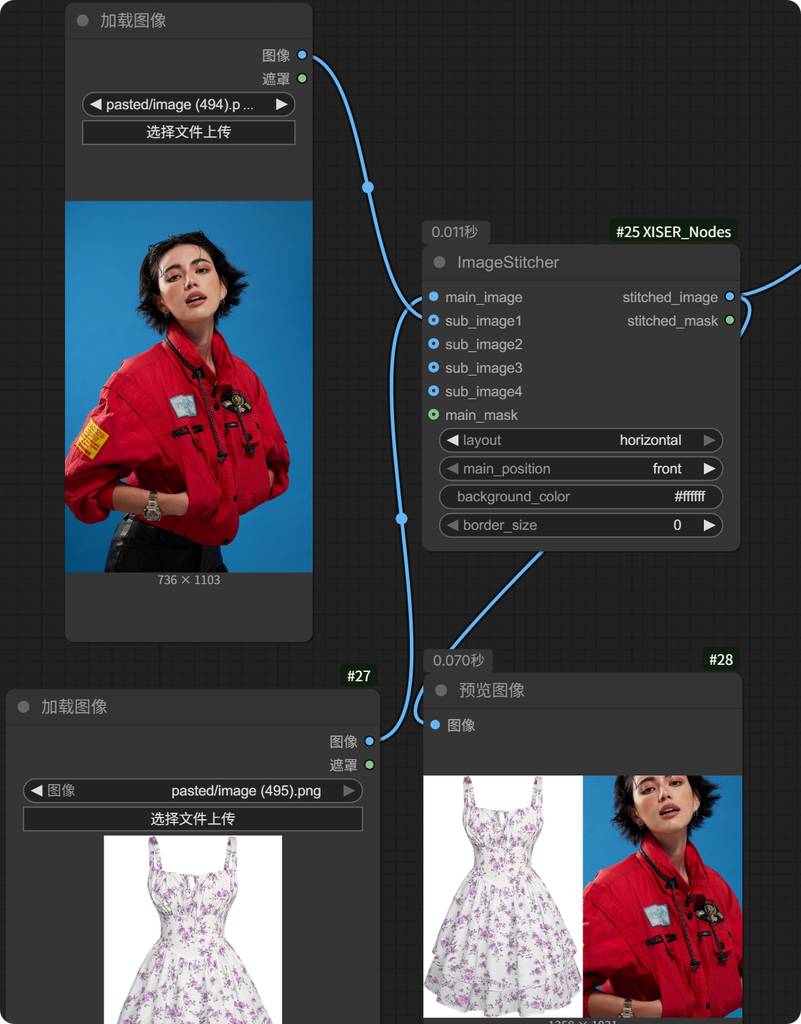

在单图流上,输入点增加ImageStitcher

其实就是拼接图片:

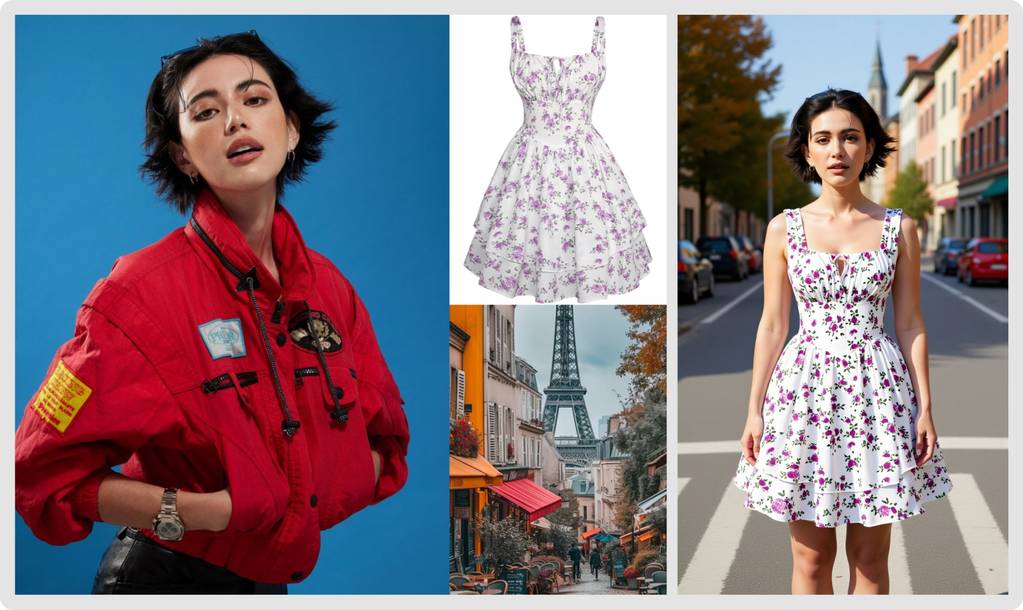

三图流

ImageStitcher节点再接图片,三张互相参考。这时候提示语就需要点技巧了。必须明确的告诉Kontext您的意图。

可以见下文的提示词技巧。也可以使用我的llm优化提示语,无脑输出。

例如提示词:

The model on the left, wearing the clothes in the upper right corner, is standing on the street in the lower right corner

关于llm优化提示词,可以看这文章:【AI辅助设计】如何让FLUX.1 Kontext指哪打哪?我尝试了这个方法。

Kontext前世今生和技巧

接下来带大家回顾一下Kontext的前世今生!懂的黑色森林公司对开源和商业是如何平衡的,口碑和商业双丰收!

第一章:迈向图像编辑新范式

1.1 FLUX. 1 Kontext的问世

由Black Forest Labs(BFL)推出的FLUX. 1 Kontext模型家族,包括[dev]、[pro]和[max]三个版本,标志着生成式人工智能领域的一次重大演进 1。其中,

FLUX. 1 Kontext [dev]版本的发布尤为关键,它首次将一个具备商业级性能的上下文感知(in-context)图像编辑模型以开放权重(open-weight)的形式提供给公众 4。其核心价值主张在于,将高质量的图像生成与基于指令的图像编辑功能统一在单个模型中,这与传统的、将文生图(text-to-image)和图生图(image-to-image)作为独立流程处理的模式形成了鲜明对比 3。这种统一框架不仅提升了效率,更为创意工作流带来了前所未有的灵活性。

1.2 [dev]版本:先进能力的民主化

本报告聚焦于FLUX. 1 Kontext [dev]模型。它是一个拥有120亿参数的精馏流变换器(rectified flow transformer)模型 8。该版本专为学术研究、模型定制和非商业性应用而设计,旨在推动科学研究的边界,并赋能艺术家开发创新的工作流程 5。本报告的核心目标是,从技术架构、性能表现、使用方法和发展前景等多个维度,对该模型进行一次全面而详尽的分析。

1.3 模型家族概览

为了清晰地定位[dev]版本在整个FLUX. 1 Kontext产品体系中的位置,下表对该模型家族的不同版本进行了对比。

表1:FLUX. 1 Kontext模型家族对比

| 特性 | FLUX. 1 Kontext [dev] | FLUX. 1 Kontext [pro] | FLUX. 1 Kontext [max] |

|---|---|---|---|

| 模型参数 | 120亿 8 | 80亿 11 | 60亿 11 |

| 主要用例 | 学术研究、模型定制、非商业应用 5 | 快速迭代编辑、商业应用 2 | 追求极致性能、高级排版、商业应用 2 |

| 获取方式 | 开放权重 (Hugging Face等) 5 | API接口 (BFL Playground及合作伙伴) 2 | API接口 (BFL Playground及合作伙伴) 12 |

| 许可协议 | FLUX. 1 [dev] 非商业许可 5 | 通过API或购买商业许可 5 | 通过API商业使用 12 |

| 核心优势 | 开放性、可定制性、社区驱动 7 | 速度与质量的平衡 3 | 卓越的指令遵循度和一致性 3 |

Black Forest Labs推出的这一模型家族,其结构并非偶然。通过同时发布一个免费、开放的[dev]版本和两个付费、闭源的[pro]与[max]版本,BFL展现了一种成熟的商业策略 1。这种策略可以被视为对AI领域开源模式的一次重要探索。BFL的创始团队核心成员来自Stability AI 14,后者虽然通过开源Stable Diffusion获得了巨大的社区影响力,但在商业化方面却面临挑战。

BFL的策略显然吸取了这些经验。[dev]版本的发布,不仅仅是出于学术共享的精神,更是一种战略布局。通过发布一个性能强大、甚至在某些方面超越现有闭源模型的开源版本 5,BFL能够迅速建立庞大的用户基础和活跃的开发者社区。这个社区不仅为模型的功能迭代和应用探索提供了海量的“外包研发”力量 14,也自然而然地成为了其商业产品的销售漏斗。当用户在

[dev]版本上验证了工作流或需要更高性能、更稳定服务以及商业使用权时,他们可以无缝地转向付费API(使用[pro]和[max]版本)或通过新推出的自助服务门户购买[dev]版本的商业许可 5。这种开源与商业共生的模式,为开源AI公司的可持续发展提供了一个范本,预示着开源AI的未来可能不再是纯粹的“为爱发电”,而是构建一个能够自我造血、健康发展的生态系统。

第二章:架构核心:从扩散到流匹配

2.1 流匹配优势:生成范式的转变

FLUX模型家族的核心技术优势在于其采用了**生成式流匹配(Generative Flow Matching)**架构 6。这与当前主流的扩散模型(Diffusion Models)在底层逻辑上存在根本差异。

传统扩散模型通过一个随机过程(Stochastic Differential Equation, SDE)逐步向图像添加噪声,直至其变为纯高斯噪声,然后再学习一个逆向过程来去噪生成图像 17。这个过程通常需要数百甚至上千个离散的步骤,导致推理速度较慢。

相比之下,流匹配技术通过常微分方程(Ordinary Differential Equation, ODE)学习一个从噪声分布到数据分布的“更平滑、更可预测的路径”或称为速度场(velocity field)18。这种方法在理论上允许模型以更少的步骤完成高质量的图像生成。FLUX模型正是利用了这一优势,将生成步骤从传统扩散模型的50步以上大幅减少到仅需4至8步,同时保持甚至超越了图像质量,从而实现了高达60-80%的推理时间缩减和数倍于竞争对手的生成速度 11。这一架构选择是FLUX模型能够支持交互式应用的根本原因。

2.2 剖析FLUX. 1 Kontext变换器

FLUX. 1 Kontext [dev]是一个拥有120亿参数的大型变换器模型,其具体架构设计紧密服务于其上下文编辑的核心功能 21。

- 精馏流变换器(Rectified Flow Transformer):模型在一个强大的、从头开始训练的变分自编码器(VAE)的潜在空间中进行操作 16。这个VAE本身就具有出色的重建能力,其性能在多项指标上优于包括SDXL-VAE在内的同类模型,为后续的生成任务奠定了高质量的基础 22。

- 混合块结构(Hybrid Block Structure):变换器的主体由“双流(double stream)”和“单流(single stream)”块混合构成。其中,双流块为图像和文本标记(tokens)设置了独立的权重,使得模型能够更精细地处理和融合这两种不同模态的信息,这对于理解复杂的编辑指令至关重要 16。

- 三维旋转位置编码(3D RoPE):为了实现灵活的空间理解能力,模型采用了3D旋转位置编码。这使得模型不仅能处理不同宽高比的图像,还能在编辑过程中更好地保持物体的三维结构和空间关系,这对于需要保持构图一致性的编辑任务来说是一项关键技术 16。

2.3 上下文编辑的实现机制

模型的标志性功能——上下文感知编辑,是通过以下几种关键机制实现的:

- 序列拼接(Sequence Concatenation):当用户提供一张参考图像和一段文本指令时,模型首先使用其冻结的FLUX自编码器将参考图像编码为一系列潜在空间中的标记(latent tokens)。然后,它将这些图像标记与文本指令的标记拼接成一个单一的序列输入到变换器中 16。这种统一的输入方式使得模型能够同时处理视觉上下文和文本指令,从而理解诸如“保持角色不变,将背景换成海滩”之类的复杂要求。

- 引导蒸馏(Guidance Distillation)与LADD:[dev]版本是使用引导蒸馏技术训练而成的 8。具体来说,它采用了潜空间对抗性扩散蒸馏(Latent Adversarial Diffusion Distillation, LADD)技术 16。这个过程将一个更大、更复杂的“教师”模型的知识“蒸馏”到一个更小、更高效的“学生”模型中(即

[dev]版本)。这解释了为什么[dev]模型能够在参数量相对较小、推理步骤更少的情况下,依然能达到接近甚至超越许多大型闭源模型的性能。

深入分析这些架构选择,可以发现它们并非孤立的技术堆砌,而是紧密围绕一个核心产品哲学:实现快速、稳健、可迭代的上下文图像编辑。流匹配技术解决了速度瓶颈;序列拼接和双流块解决了多模态理解问题;3D RoPE解决了空间一致性问题。这表明BFL的研发路径并非简单地追求在文生图任务上获得更高的单次生成质量,而是从根本上重新设计了生成模型,以解决一个更具体、更高价值的交互式编辑问题。FLUX. 1 Kontext因此成为了一个典范,展示了如何让特定的高级应用场景(如专业内容创作、迭代设计)来驱动底层模型架构的创新。

第三章:性能评估与竞争格局

3.1 KontextBench:真实世界编辑任务的新标准

为了更准确地评估上下文编辑模型的真实能力,Black Forest Labs构建并推出了一个名为KontextBench的全新基准测试集 21。BFL指出,现有的编辑模型基准测试(如InstructPix2Pix)大多依赖于合成数据,这会导致评估结果存在偏差且无法完全反映真实世界的使用场景 22。

KontextBench旨在解决这一问题,它包含了1026个独特的“图像-指令”对,这些数据均来自众包的真实世界用例,涵盖了个人照片、CC许可的艺术作品、公共领域图像以及AI生成内容等多种来源 22。该基准测试覆盖了五个核心的上下文编辑任务类别,具体分布如下 22:

- 局部指令编辑(Local instruction editing):416个样本

- 全局指令编辑(Global instruction editing):262个样本

- 文本编辑(Text editing):92个样本

- 风格参考(Style reference):63个样本

- 角色参考(Character reference):193个样本

KontextBench的推出,为衡量和比较不同模型在复杂、真实的编辑场景下的性能提供了一个更公平、更具代表性的平台。

3.2 定量性能分析

基于KontextBench和其他基准测试的评估结果显示,FLUX. 1 Kontext [dev]的性能极具竞争力,不仅超越了现有的开源编辑模型,甚至在多个维度上媲美乃至优于顶级的闭源商业模型 5。

表2:KontextBench性能与推理速度对比

| 模型 | 人类偏好 - 局部编辑 | 人类偏好 - 角色保持 | 人类偏好 - 文本编辑 | 中位推理延迟 (1024×1024) |

|---|---|---|---|---|

| FLUX. 1 Kontext [max] | 领先 24 | 极高 (AuraFace > 0.92) 24 | 领先 2 | ~3-5秒 11 |

| FLUX. 1 Kontext [pro] | 高 2 | 领先 2 | 高 2 | ~3-5秒 22 |

| FLUX. 1 Kontext [dev] | 优于Gemini-Flash 5 | 高 8 | 优于开源模型 5 | ~3-5秒 22 |

| GPT-Image-1 / GPT-4o | 具竞争力 27 | 较差 (易改变细节) 27 | 具竞争力 2 | ~16.8秒 (Imagen 4) 11 |

| Google Gemini-Flash | 弱于FLUX. 1 [dev]5 | 未知 | 未知 | 具竞争力,但慢于FLUX 25 |

| Midjourney v6 | 未直接比较 | 未知 | 未知 | ~8.7秒 11 |

注:数据综合自多个来源,人类偏好得分是相对排名。推理速度为近似值,可能因硬件和具体任务而异。

从数据中可以清晰地看到,FLUX模型家族在保持角色一致性和文本编辑这两项关键的上下文编辑任务上表现尤为突出,这正是传统模型的主要痛点。更重要的是,它们在实现高质量编辑的同时,保持了极高的推理速度,通常比GPT-4o或Imagen 4等模型快数倍 2,这对于需要快速反馈和迭代的交互式应用至关重要。

[dev]版本作为开源模型,其性能表现足以对标甚至超越一些强大的闭源对手,这充分证明了其架构的先进性。

3.3定性能力:优势与局限

除了量化数据,FLUX. 1 Kontext的定性表现同样令人印象深刻,但也存在明确的边界。

优势:

- 稳健的角色一致性:模型最受赞誉的能力之一,是在连续多次编辑中保持角色(或物体)的身份特征,包括面部、服装和风格,视觉漂移极小 8。用户可以基于一张参考照片,将同一个人置于完全不同的场景和环境中 7。

- 精准的局部编辑:用户可以对图像的特定元素(如汽车颜色、人物发型、背景)进行精确修改,而不会影响图像的其他部分,实现了真正的“指哪打哪” 2。

- 高效的风格迁移:模型能够根据文本指令,将参考图的独特艺术风格(如油画、素描、动画)应用到新场景中,同时保留关键的构图和内容元素 30。

- 卓越的图像内文本处理:与其他模型相比,FLUX在编辑图像内的文本(如标牌、海报)方面表现出色,能够更自然地替换文字并保持原有字体风格 13。

局限性:

- 迭代次数的限制:尽管模型支持迭代编辑,但这种能力并非无限。官方文档和社区测试均表明,在进行过多的连续编辑(例如超过六次)后,生成图像的质量会开始下降,出现可见的视觉伪影(artifacts)和细节退化 2。

- 复杂指令的遵循:在处理极其复杂或包含多个矛盾约束的指令时,模型偶尔会“忽略”部分要求,无法完美执行所有指令 3。

这些观察揭示了一个重要的使用策略。FLUX. 1 Kontext并非一个可以无限次修改而无损耗的魔法工具。它的核心优势体现在一个“迭代甜点区”(iterative sweet spot)内,通常是在2到5次编辑之间。在这个区间内,模型能最大化地发挥其保持一致性的能力,提供远超竞争对手的价值。然而,一旦超出这个范围,累积的微小误差(即视觉漂移)会导致编辑效果的边际效益递减。

因此,要真正掌握这个模型,用户需要培养一种新的技能:“迭代工作流管理”。高效的使用者不再是试图用一个冗长复杂的指令一步到位,而是学会将最终的创意构想分解为一系列简短、可控的编辑序列,确保每个序列都落在模型的“甜点区”内。这也为BFL的未来研发指明了方向:如何通过改进模型架构和训练方法,进一步扩展这个“甜点区”,提升模型在更长编辑链条中的鲁棒性。

第四章:实施与实用指南

4.1 使用ComfyUI进行本地部署

对于希望在本地环境中运行FLUX. 1 Kontext [dev]的开发者和高级用户,ComfyUI提供了最直接和灵活的方式。部署过程需要遵循特定的步骤和配置。

首先,必须确保使用的是最新开发版(Nightly)的ComfyUI,因为稳定版或桌面版可能不包含支持FLUX Kontext所需的最新节点 29。

其次,需要下载一系列模型文件,并将其放置在ComfyUI目录下的指定位置。以下是部署所需的核心组件列表。

表3:FLUX. 1 Kontext [dev]的ComfyUI设置清单

| 组件 | 模型文件名 | 所需节点 | 下载来源/链接 |

|---|---|---|---|

| 主扩散模型 | flux1-dev-kontext_fp8_scaled. Safetensors | Load Diffusion Model | Hugging Face |

| VAE | ae. Safetensors | Load VAE | Hugging Face |

| 文本编码器 1 | clip_l.safetensors | DualCLIP Load | Hugging Face |

| 文本编码器 2 | t5xxl_fp16. Safetensors 或 t5xxl_fp8_e4m3fn_scaled. Safetensors | DualCLIP Load | Hugging Face |

注:所有模型文件均可在Comfy-Org的Hugging Face仓库中找到 33。

配置完成后,用户可以根据官方提供的示例工作流(workflow)进行操作,这些工作流通常分为基础版和使用组节点的简化版 29。核心节点包括

Load Diffusion Model(加载主模型)、DualCLIP Load(加载双文本编码器)、Load VAE(加载VAE)以及用于输入待编辑图像的Load Image或Load Image (from output) 节点 29。

4.2 硬件需求:显存(VRAM)的考量

本地部署FLUX. 1 Kontext [dev]最大的门槛是硬件,特别是显存(VRAM)的大小。作为一个120亿参数的模型,其资源消耗不容小觑。综合Reddit等社区的大量用户反馈,可以得出以下关于显存需求的实际情况。

表4:本地推理的VRAM需求(社区反馈汇总)

| GPU显存 | 模型格式 | 报告的性能/状态 |

|---|---|---|

| 8GB | GGUF Q4/Q5, FP8 (需系统内存分担) | 可能运行。使用低位量化(GGUF)版本是关键。速度可能较慢,但有成功运行的报告 35。 |

| 12GB | FP8, GGUF Q8/Q5_KM | 体验良好。可以稳定运行FP8版本和较高质量的GGUF量化版本 35。 |

| 16GB | FP8 | 流畅运行。FP8版本在此显存下运行稳定,峰值消耗约14.3GB 37。 |

| 20GB+ | 完整/FP16 | 推荐配置。要运行未经量化的完整模型,至少需要20GB显存 36。 |

从上表可以看出,GGUF量化是让该模型在消费级显卡上运行的关键。社区成员迅速推出了GGUF格式的量化版本 26,通过降低模型精度(如从FP16降至8位或4位整数)来大幅减少显存占用。这使得拥有8GB或12GB显卡的用户也能体验到

FLUX. 1 Kontext [dev]的强大功能,尽管可能会牺牲一些速度或精度。这一社区驱动的优化工作,极大地降低了模型的准入门槛,是开源生态活力的直接体现。

4.3 基于云的API集成

对于不具备本地部署条件或需要将模型集成到商业应用中的开发者,通过云服务提供商的API是更便捷的选择。多家主流AI平台迅速提供了对FLUX. 1 Kontext [dev]的支持,包括Fal. Ai、Replicate、Together AI、DataCrunch等 8。

使用API通常涉及以下几个方面:

- API参数:调用API时需要提供一系列参数来控制生成过程。常见的参数包括 40:

- prompt (string): 描述编辑指令的文本。

- image_url (string): 待编辑图像的URL或Base64编码数据。

- num_inference_steps (integer): 推理步数,影响细节和速度。

- guidance_scale (float): 指导权重(CFG),控制模型对指令的遵循程度。

- seed (integer): 随机种子,用于生成可复现的结果。

- 定价模式:各平台的定价模式不尽相同,常见的是按生成图像的数量或分辨率(百万像素)计费。例如,Replicate和Fal. Ai的定价约为每张图像$0.025美元 41。

4.4 掌握提示词:高效编辑指南

与FLUX. 1 Kontext的交互是一门艺术,有效的提示词(prompting)是释放其全部潜力的关键。综合官方文档和社区的最佳实践,可以总结出以下核心策略 1:

核心原则:

- 明确具体 (Be Specific):使用精确的语言,避免模糊的词汇如“让它更好看”。直接指明颜色、物体和风格。

- 从简开始 (Start Simple):先进行简单的、单一的修改。模型支持迭代,可以逐步构建复杂的编辑。

- 主动保留 (Preserve Intentionally):明确指出哪些元素不应该改变。使用“while maintaining…”(同时保持…)或“keeping…”(保留…)等短语来保护关键特征。

- 迭代求精 (Iterate When Needed):将复杂的、多步骤的修改分解为一系列简单的编辑指令,分步执行。

实用技巧:

- 动词选择:精确选择动词。使用change(改变)、replace(替换)、add(添加)等具体动词,而不是transform(转换)这种可能导致全局重绘的词。

- 直接指代:避免使用“it”、“she”、“he”等代词。直接描述主体,如“the woman with short black hair”(那个留短黑发的女人)。

- 文本编辑:使用引号来精确指定要修改的文本,例如:“Replace ‘SALE’ with ‘SOLD’”(将‘SALE’替换为‘SOLD’)。

- 构图控制:在改变背景或场景时,如果想保持原始构图,需要明确指示,例如:“keep the exact camera angle, position, and framing”(保持完全相同的相机角度、位置和构图)。

掌握这些技巧,用户可以更精准地控制编辑过程,最大限度地减少意外的改动,从而在“迭代甜点区”内高效地完成创作。

第五章:开源生态与未来轨迹

5.1 开源项目的健康状况

FLUX. 1 Kontext [dev]的长期价值不仅取决于其技术本身,还依赖于其开源生态的健康与活力。对其官方GitHub仓库black-forest-labs/flux的分析可以提供一个窗口。

截至分析时,该仓库已积累了相当的关注度,拥有数万星标和上千次复刻(forks)44。仓库活动显示有数十名贡献者和数百个提交(commits),表明其背后有一个积极的开发团队 45。更重要的是社区的参与度,体现在“Issues”(问题)和“Pull Requests”(拉取请求)板块 46。

- 问题(Issues):仓库中有上百个开放的问题 46。这些问题的内容五花八门,从用户遇到的技术bug(如CUDA错误、登录问题)46,到对模型性能的讨论(如效率、角色一致性、指令遵循能力)32,再到功能请求(如无缝平铺、训练代码文档)46。这表明社区正在积极地对模型进行压力测试,并反馈真实的性能瓶颈和用户需求,为模型的持续改进提供了宝贵的数据。

- 拉取请求(Pull Requests):社区成员不仅提出问题,还通过提交代码来直接贡献解决方案,例如修复bug、添加新功能(如LoRA微调指南、Docker支持)以及改进文档 47。

综合来看,black-forest-labs/flux项目展现出一个健康、活跃的开源生态。官方团队在维护,社区在积极参与,这种双向互动是推动项目长期发展的核心动力。

5.2 许可、商业化与安全

FLUX. 1 Kontext [dev]的发布伴随着一套清晰的规则框架,旨在平衡开放性、商业潜力和社会责任。

- 许可协议:模型采用FLUX. 1 [dev] Non-Commercial License(非商业许可)发布 8。这意味着个人用户和研究者可以免费使用该模型进行学习和实验,但任何直接的商业用途都受到限制。关于模型生成物的商业使用权,社区中存在一些讨论,但官方许可的立场是明确的 4。

- 商业化路径:对于希望将模型用于商业产品或服务的企业,Black Forest Labs提供了明确且便捷的途径。他们推出了一个自助服务许可门户(Self-Serve Licensing Portal),企业可以在该门户网站上以透明的条款和标准化的价格,点击几下即可购买包括FLUX. 1 Kontext [dev]在内的所有BFL开源模型的商业许可 5。这大大降低了商业化的门槛,加速了从开发到部署的进程。

- 安全与风险缓解:BFL强调其对负责任AI的承诺。在模型发布前,他们采取了一系列措施来降低滥用风险 8。这包括:

- 预训练数据过滤:过滤了多个类别的“不适宜工作场所”(NSFW)内容。

- 后训练安全微调:与互联网观察基金会(IWF)等组织合作,过滤已知的儿童性虐待材料(CSAM),并进行多轮针对性微调,以抑制模型生成非法或有害内容(如非自愿私密图像NCII)的能力。

- 部署要求:非商业许可协议明确要求,任何部署该模型提供服务的用户必须使用内容过滤器或进行人工审核,BFL保留随机核查的权利 5。

5.3 Black Forest Labs的战略愿景

通过分析BFL创始人的访谈和官方公告,可以勾勒出该公司长远的战略蓝图。

- 核心理念:BFL的创始人,多位是Stable Diffusion的核心研究者,对开源有着深刻的信念 14。他们认为,开放研究和共享权重是推动技术安全创新、吸引顶尖人才和加速生态系统发展的根本 14。

- 未来路线图:虽然没有公布详细的时间表,但BFL的未来方向非常明确。视频生成被反复提及为下一个技术前沿 14。此外,

交互式3D内容创建也是一个重点关注领域 23。 - 战略合作:与NVIDIA的深度合作是其战略的关键一环。BFL不仅为NVIDIA最新的Blackwell架构优化了模型(推出FP4格式权重以在消费级GPU上实现更高效率),还共同推出了一个结合Blender等3D应用的“3D引导生成AI蓝图” 5。这表明BFL的目标不仅是2D图像,而是要进军由3D场景驱动的高性能、专业级创意工作流。

这一切线索指向一个更宏大的叙事。FLUX. 1 Kontext并不仅仅是一个图像编辑器,它更像是BFL宏伟蓝图中的一个战略基石。BFL的联合创始人Andreas Blattmann曾明确表示:“要解决视频生成问题,模型需要学习世界的物理基础” 14。这清晰地将图像的一致性、视频的连贯性和3D的空间结构联系在了一起。视频本质上是时间维度上保持一致的图像序列,而3D场景则为这种一致性提供了最根本的结构约束。

因此,可以推断,FLUX. 1 Kontext项目是BFL为攻克“文生视频”这一终极挑战而采取的深思熟虑的第一步。他们在相对简单的2D图像领域,首先集中力量解决了“一致性”这个核心难题,并围绕它构建了核心技术、社区生态和商业模式。当这个基础被夯实之后,再将这套成熟的“一致性”解决方案应用到计算量更大、难度更高的视频和3D领域。这使得BFL在与OpenAI(Sora)、Google(Veo)等巨头的竞争中,展现出一条清晰、务实且极具潜力的发展路径。他们的路线图并非功能的堆砌,而是向着真正的“世界模型”迈进的逻辑演化。

5.4 结论与建议

FLUX. 1 Kontext [dev]无疑是开源生成式AI领域的一个里程碑。它凭借在流匹配架构上的创新,成功地在交互式图像编辑这一细分赛道上,对强大的闭源商业模型发起了有力挑战,并在速度和迭代一致性方面取得了切实的优势。

然而,它并非一个即插即用的“魔法棒”。要释放其全部潜力,用户需要具备一定的技术能力、掌握特定的提示词技巧,并配备足够的硬件资源。它是一个为专业人士和高级爱好者准备的强大工具。

基于本报告的全面分析,为不同类型的用户提供以下建议:

- 对于研究人员:应重点关注其新颖的流匹配架构、双流多模态处理机制以及3D RoPE等技术细节。KontextBench提供了一个高质量的、面向真实世界应用的评估平台,可用于未来相关研究的比较和验证。

- 对于开发者:可以利用其开放权重进行模型的定制化微调,或将其集成到新的应用中。但在进行商业化部署前,必须仔细研究其许可协议,并通过官方渠道获取商业授权。同时,需充分评估本地部署的硬件成本或云API的使用成本。

- 对于艺术家与创作者:建议从Replicate、Fal. Ai等提供便捷试用环境的云平台开始体验。若计划本地部署,需确保拥有至少12GB VRAM的显卡。学习并掌握本报告中提到的“迭代工作流管理”和高级提示词技巧,是将该模型从一个有趣的玩具转变为强大生产力工具的关键。

Works cited

- Flux Kontext - Try Flux. 1 Kontext to Edit Images for Free | Flux AI, accessed June 27, 2025, https://flux1.ai/flux-kontext

- Black Forest Labs Releases FLUX. 1 Kontext: Context-Aware Image Editing Model Suite, accessed June 27, 2025, https://comfyui-wiki.com/en/news/2025-05-30-flux-kontext-release

- Introducing FLUX. 1 Kontext and the BFL Playground - Black Forest Labs, accessed June 27, 2025, https://bfl.ai/announcements/flux-1-kontext

- FLUX. 1 Kontext [dev] - an open weights model for proprietary-level image editing performance. : r/LocalLLaMA - Reddit, accessed June 27, 2025, https://www.reddit.com/r/LocalLLaMA/comments/1ll38zu/flux1_kontext_dev_an_open_weights_model_for/

- FLUX. 1 Kontext [Dev] – Open Weights for Image … - Black Forest Labs, accessed June 27, 2025, https://bfl.ai/announcements/flux-1-kontext-dev

- Flux-kontext Serverless API - Segmind, accessed June 27, 2025, https://www.segmind.com/models/flux-kontext-dev

- FLUX. 1 Kontext models: Character consistency and precise image editing without fine-tuning - Together AI, accessed June 27, 2025, https://www.together.ai/blog/flux-1-kontext

- Black-forest-labs/FLUX. 1-Kontext-dev - Hugging Face, accessed June 27, 2025, https://huggingface.co/black-forest-labs/FLUX.1-Kontext-dev

- FLUX. 1 Kontext’s Consistent Characters, Benchmarking Costs Climb, and more… - DeepLearning. AI, accessed June 27, 2025, https://www.deeplearning.ai/the-batch/issue-305/

- 8.25 kB - Hugging Face, accessed June 27, 2025, https://huggingface.co/bullerwins/FLUX.1-Kontext-dev-GGUF/resolve/main/README.md?download=true

- FLUX. 1 Kontext: Making Image Creation and Editing Very Simple with AI - MPG ONE, accessed June 27, 2025, https://mpgone.com/flux-1-kontext-making-image-creation-and-editing-very-simple-with-ai/

- FLUX. 1 Kontext [max] | Advanced Text-to-Image Editing - Replicate, accessed June 27, 2025, https://replicate.com/black-forest-labs/flux-kontext-max

- Use FLUX. 1 Kontext to edit images with words – Replicate blog, accessed June 27, 2025, https://replicate.com/blog/flux-kontext

- Black Forest Labs: Europe’s most-hyped — and elusive — startup? | Sifted, accessed June 27, 2025, https://sifted.eu/articles/black-forest-labs

- Former Stability AI core members set up a new company to release Flux. 1 open source image generation model, accessed June 27, 2025, https://braintitan.medium.com/former-stability-ai-core-members-set-up-a-new-company-to-release-flux-1-5472db0e4aae

- FLUX. 1 Kontext Max - RunComfy, accessed June 27, 2025, https://www.runcomfy.com/playground/blackforestlabs/flux-1-kontext-max

- An Introduction to Flow Matching and Diffusion Models, accessed June 27, 2025, https://diffusion.csail.mit.edu/docs/lecture-notes.pdf

- Flow Matching vs Diffusion. Briefly going into mathematical… - Harsh Maheshwari, accessed June 27, 2025, https://harshm121.medium.com/flow-matching-vs-diffusion-79578a16c510

- [D] Diffusion vs Flow : r/MachineLearning - Reddit, accessed June 27, 2025, https://www.reddit.com/r/MachineLearning/comments/1eki8kn/d_diffusion_vs_flow/

- Diff2Flow: Training Flow Matching Models via Diffusion Model Alignment - CVPR 2025, accessed June 27, 2025, https://cvpr.thecvf.com/virtual/2025/poster/32927

- [2506.15742] FLUX. 1 Kontext: Flow Matching for In-Context Image Generation and Editing in Latent Space - arXiv, accessed June 27, 2025, https://arxiv.org/abs/2506.15742

- FLUX. 1 Kontext: Flow Matching for In-Context Image Generation and Editing in Latent Space - arXiv, accessed June 27, 2025, https://arxiv.org/html/2506.15742v2

- Flux Tech Details by Robin Rombach (CEO, Black Forest Labs) : r/StableDiffusion - Reddit, accessed June 27, 2025, https://www.reddit.com/r/StableDiffusion/comments/1isd2qy/flux_tech_details_by_robin_rombach_ceo_black/

- The BEST AI Image Generator On The Internet Just Launched | HackerNoon, accessed June 27, 2025, https://hackernoon.com/the-best-ai-image-generator-on-the-internet-just-launched

- Flux Kontext Is Best For Image Editing and Character Consistency - Zeniteq, accessed June 27, 2025, https://www.zeniteq.com/flux-kontext-is-the-best-ai-image-model

- Bullerwins/FLUX. 1-Kontext-dev-GGUF - Hugging Face, accessed June 27, 2025, https://huggingface.co/bullerwins/FLUX.1-Kontext-dev-GGUF

- FLUX. 1 Kontext - Hacker News, accessed June 27, 2025, https://news.ycombinator.com/item?id=44128322

- How will flux kontext be used one the open source version is released? - Reddit, accessed June 27, 2025, https://www.reddit.com/r/StableDiffusion/comments/1kzyet5/how_will_flux_kontext_be_used_one_the_open_source/

- ComfyUI Official Documentation - ComfyUI, accessed June 27, 2025, https://docs.comfy.org/tutorials/flux/flux-1-kontext-dev

- FLUX. 1 Kontext powers your edits. Fal handles your scale., accessed June 27, 2025, https://fal.ai/flux-kontext

- Flux-kontext-dev model collection - WaveSpeedAI, accessed June 27, 2025, https://wavespeed.ai/collections/flux-kontext-dev

- Flux doesn’t understand composition · Issue \ #98 · black-forest-labs/flux - GitHub, accessed June 27, 2025, https://github.com/black-forest-labs/flux/issues/98

- Comfy-Org/flux1-kontext-dev_ComfyUI - Hugging Face, accessed June 27, 2025, https://huggingface.co/Comfy-Org/flux1-kontext-dev_ComfyUI

- README. Md · Comfy-Org/flux1-kontext-dev_ComfyUI at main - Hugging Face, accessed June 27, 2025, https://huggingface.co/Comfy-Org/flux1-kontext-dev_ComfyUI/blob/main/README.md

- New FLUX. 1-Kontext-dev-GGUFs : r/StableDiffusion - Reddit, accessed June 27, 2025, https://www.reddit.com/r/StableDiffusion/comments/1ll9q52/new_flux1kontextdevggufs/

- Flux Kontext Dev is pretty good. Generated completely locally on ComfyUI. - Reddit, accessed June 27, 2025, https://www.reddit.com/r/StableDiffusion/comments/1ll38bu/flux_kontext_dev_is_pretty_good_generated/

- Flux Kontext is out for ComfyUI : r/comfyui - Reddit, accessed June 27, 2025, https://www.reddit.com/r/comfyui/comments/1ll3ewk/flux_kontext_is_out_for_comfyui/

- Flux. 1 Kontext [dev] Day-0 Native Support in ComfyUI! - Reddit, accessed June 27, 2025, https://www.reddit.com/r/comfyui/comments/1ll3emk/flux1_kontext_dev_day0_native_support_in_comfyui/

- WaveSpeedAI - Ultimate Platform for Accelerating AI Image and Video Generation, accessed June 27, 2025, https://wavespeed.ai/

- FLUX. 1 Kontext [dev] | Image to Image - Fal. Ai, accessed June 27, 2025, https://fal.ai/models/fal-ai/flux-kontext/dev/api

- FLUX. 1 Kontext [dev] | Image to Image | fal. Ai, accessed June 27, 2025, https://fal.ai/models/fal-ai/flux-kontext/dev

- Wavespeed-ai/flux-kontext-dev - WaveSpeedAI, accessed June 27, 2025, https://wavespeed.ai/models/wavespeed-ai/flux-kontext-dev

- Black-forest-labs/flux-kontext-dev | Readme and Docs - Replicate, accessed June 27, 2025, https://replicate.com/black-forest-labs/flux-kontext-dev/readme

- Black-forest-labs - GitHub, accessed June 27, 2025, https://github.com/black-forest-labs

- Black-forest-labs/flux: Official inference repo for FLUX. 1 … - GitHub, accessed June 27, 2025, https://github.com/black-forest-labs/flux

- Issues · black-forest-labs/flux - GitHub, accessed June 27, 2025, https://github.com/black-forest-labs/flux/issues

- Pull requests · black-forest-labs/flux - GitHub, accessed June 27, 2025, https://github.com/black-forest-labs/flux/pulls

- Black-forest-labs/FLUX. 1-dev · Has anyone had success running this model with a 7900XTX on WSL2 (Ubuntu)? - Hugging Face, accessed June 27, 2025, https://huggingface.co/black-forest-labs/FLUX.1-dev/discussions/89

- Black Forest Labs on FLUX | Alessandro Perilli, accessed June 27, 2025, https://perilli.com/ai/black-forest-labs-on-flux/

- Robin Rombach - NEXT Conference, accessed June 27, 2025, https://nextconf.eu/person/robin-rombach/

- Major News from Grok’s Black Forest Labs, Google, OpenAI’s o1, Jony Ive, and Plaud’s NotePin | Passionate Agency, accessed June 27, 2025, https://passionates.com/major-news-from-groks-black-forest-labs-google-openais-o1-jony-ive-and-plauds-notepin/

- Black Forest Labs Raises $100M, Reaches $1B Valuation | Festina Lente, accessed June 27, 2025, https://www.turtlesai.com/en/pages-1374/black-forest-labs-raises-$100m-reaches-$1b-valuati

- Bringing Lightning-Fast FLUX Performance to More Creators in Collaboration with NVIDIA - Black Forest Labs, accessed June 27, 2025, https://bfl.ai/flux-nvidia-blackwell

- The fastest Flux. 1: FP4 Flux running live on a RTX 5090 \ #flux1 - YouTube, accessed June 27, 2025, https://www.youtube.com/watch?v=yeNE8rZge5o

想获取更多 AI 辅助设计和设计灵感趋势? 欢迎关注我的公众号(设计小站):sjxz00。