5分钟阅读

这下挺稳!Blender+Kontext+VACE稳定输出CG

前言

虽然WAN2.1 VACE已经出了很久了,但是一直没时间尝试。我始终相信,AI是可以为设计加速的。相信设计师们,特别是做渲染的同学,都为通宵渲视频而发愁,渲染出来后,又不能随意修改场景和氛围。着实头痛~😭。

今天我们尝试基于Blender,结合Kontext和WACE,快速生成视频。

先看效果

由于本地机器扛不住,所以不敢用14B模型,尺寸也小了点,但是可以感觉到画面是很稳定的。

黄昏的天气下。

视频版:

制作过程

再次强调哈,AI只是辅助设计,更多的场景设计和动画设计,还是需要在Blender完成。

场景不是原创的,是我跟着老外的教程做的案例 ,我借着这份文件,快速演示过程。

Blender部分

渲染静帧

这个是输入到AI的主风格图。

制作动画和录屏

镜头和车辆移动动画,直接录屏即可,也不用渲染输出了。

ComfyUI部分

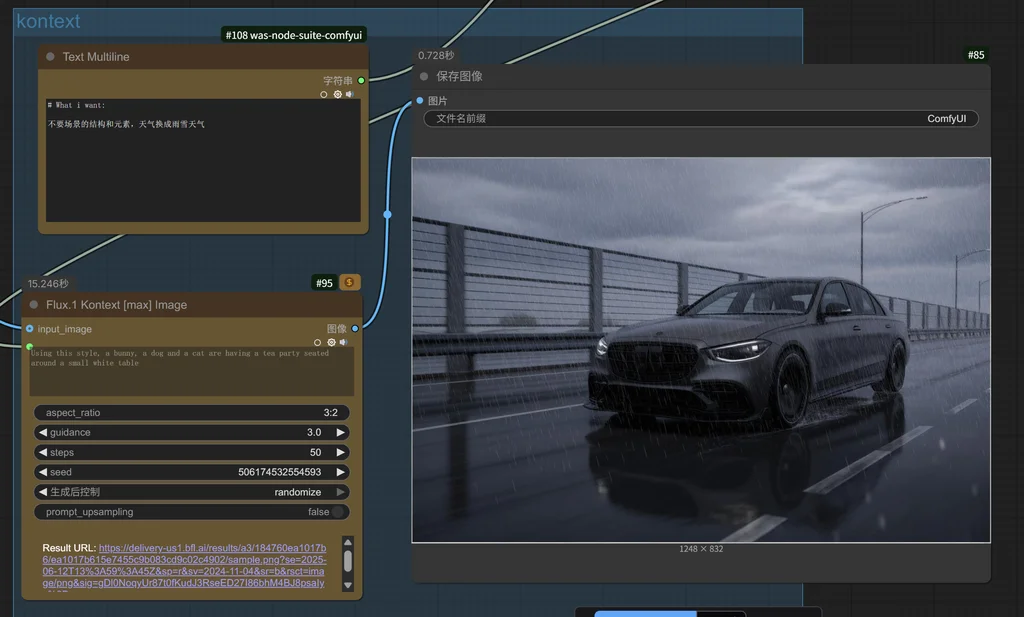

使用Kontext进行重绘

这步可选,可以改变主场景的氛围。使用我介绍第二个方法,可以快速进行精准重绘:# 【AI辅助设计】如何让FLUX.1 Kontext指哪打哪?我尝试了这个方法。

黄昏

雨雪

赛博朋克

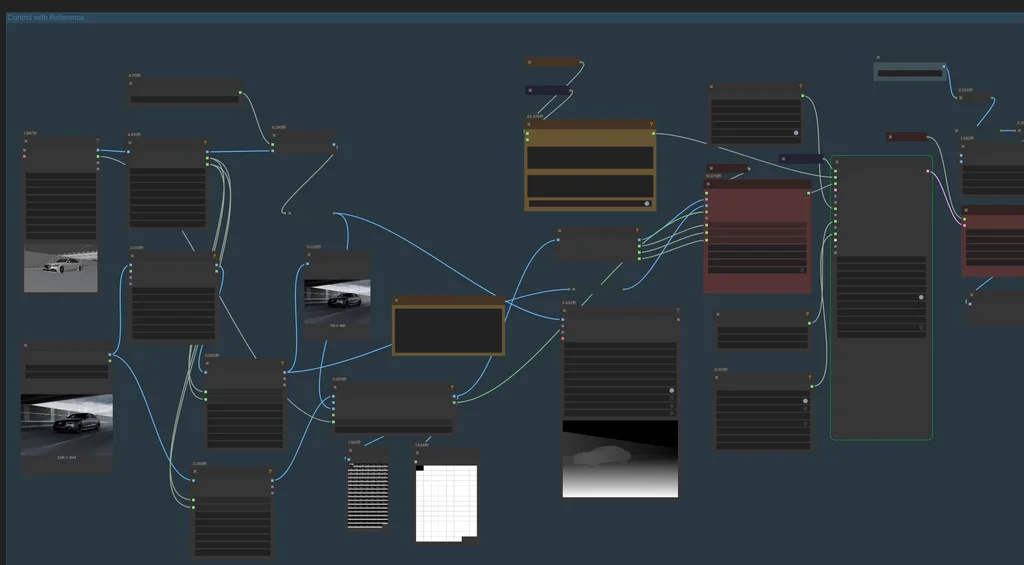

使用VACE 转绘视频

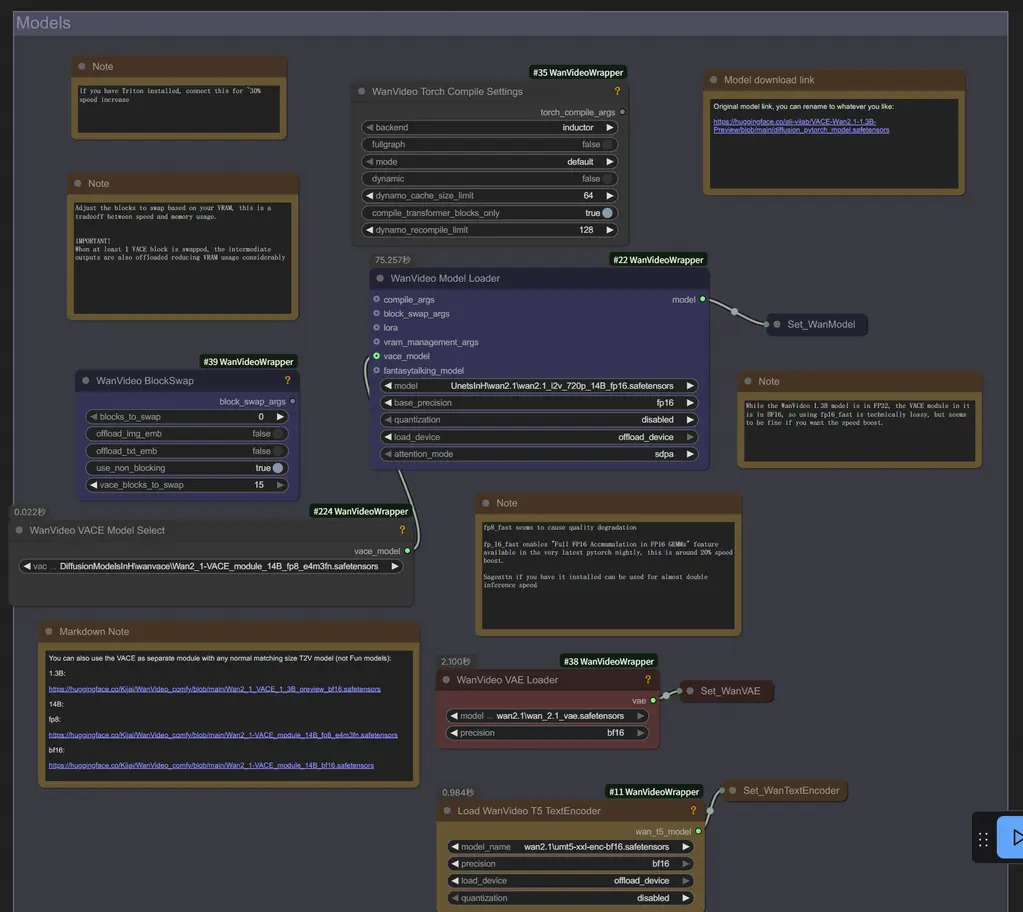

使用kj大佬的节点和流程即可,工作流在这里找:https://github.com/kijai/ComfyUI-WanVideoWrapper/tree/main/example_workflows。

提示语很简单:

Speeding car, motion blur

模型加载,最后我用的1.3b的小模型,是在扛不住了~😂。

通过深度重绘视频。

分别上传图片和录屏。

过程还是挺顺畅的,也可控,我想这就是开源的意义吧。但是对硬件要求也确实高!期待进一步有好的加速模型的出现。

想获取更多 AI 辅助设计和设计灵感趋势? 欢迎关注我的公众号(设计小站):sjxz00。