5分钟阅读

Midjourney Video v1指南:美学优先,设计师首选!

【AI辅助设计】Midjourney Video v1指南:美学优先,设计师首选!

写在前面

在前两周,Midjourney Video v1发布了公测,当时从其放出的视频片段,我还说质量对于veo3、可灵等一众视频模型,还有差距,结果打脸了🤦♂️。

经过网友们的大量测试,Midjourney Video的效果是非常的好,主要体现在:美!极具艺术感!这跟他的图像生产模型如出一辙,强调美学优先,这下子设计师知道怎么选了。

经过网友们的大量测试,Midjourney Video的效果是非常的好,主要体现在:美!极具艺术感!这跟他的图像生产模型如出一辙,强调美学优先,这下子设计师知道怎么选了。

写实的人物

超现实风格

艺术风格

漫画

今天,我们搜罗了一些资料,呕心沥血为大家整理一份指南,供大家参考!建议收藏。

Midjourney Video v1指南

第一部分:引言——Midjourney从静态图像到动态世界的飞跃

2025年6月18日,Midjourney正式发布其首个AI视频模型——Video v1,标志着这家在AI图像生成领域享有盛誉的公司正式进军视频创作领域 1。然而,要深入理解Video v1的特性与潜力,必须首先把握其背后的核心战略哲学。这并非一款旨在与现有电影级视频生成器直接竞争的产品,而是实现一个更宏大愿景的基石。

核心愿景:通往“世界模拟”的“垫脚石”

Midjourney的首席执行官David Holz明确指出,Video v1是公司长远目标的一个“垫脚石”或“构建模块” 2。这个终极目标并非仅仅是制作视频剪辑,而是构建能够进行“实时、开放世界模拟”的系统 2。想象一个AI系统,它能实时生成图像,用户可以在3D空间中自由移动,环境与角色随之动态演变,并能与万物互动 2。要实现这一目标,需要多个独立的模块:视觉生成(已有的图像模型)、动态生成(视频模型)、空间导航(未来的3D模型)以及实时处理能力。Video v1正是这个宏伟蓝图中的“动态”模块 2。

这种战略定位解释了Video v1在设计上的一些关键取舍。它没有追求极致的视频分辨率或复杂的文本到视频(T2V)功能,而是优先考虑了生成速度、时间一致性(temporal consistency)和可访问性,这些对于未来实现实时模拟至关重要 7。

美学优先的设计哲学

与许多专注于照片级真实感或商业广告素材(B-roll)的竞争对手不同,Midjourney Video v1延续了其在图像生成领域一贯的“美学优先”理念 8。该模型的设计重点在于保持Midjourney标志性的、富有艺术感的视觉风格,并确保其易于使用、充满乐趣 2。这种策略旨在服务其庞大的艺术家和创意用户社群,让他们能够将自己钟爱的静态艺术作品无缝转化为动态形式,同时保持风格的完整性。

市场背景与法律环境

Video v1的发布使其进入了一个竞争激烈的市场,与OpenAI的Sora、Google的Veo 3以及Runway等知名工具同台竞技 3。值得注意的是,此次发布恰逢Midjourney面临来自迪士尼(Disney)和环球影业(Universal)等媒体巨头的法律挑战,这些公司指控其在模型训练中涉嫌侵犯版权 3。这一背景为理解Midjourney在生成内容方面的立场和未来发展增添了重要的行业视角。

第二部分:基础工作流程——几分钟内完成你的第一个动画

掌握Midjourney Video v1的第一步是熟悉其核心工作流程。整个过程直观且高效,专为快速将静态图像赋予生命而设计。

平台说明:网页端是关键

首先需要明确的是,Video v1在发布初期是一个仅限网页端的功能,用户需通过官网 midjourney. Com 进行操作 2。尽管一些早期信息曾提及Discord,但官方的视频生成和管理界面完全基于网页。这一决策具有战略意义:视频生成涉及预览、时间线和参数滑块等交互元素,这些在网页UI中比在Discord的文本命令环境中更容易实现和操作 9。

图像到视频(I2V)的核心工作流

Video v1采用纯粹的**图像到视频(Image-to-Video, I2V)**工作流,不支持直接从文本生成视频(Text-to-Video, T2V) 4。这意味着,每一次创作都始于一张静态图像,这为用户提供了对初始视觉画面的绝对控制权。

分步指南:从图像到动态

- 登录并选择套餐:用户必须拥有一个有效的Midjourney订阅套餐,基础套餐起价为每月10美元 8。

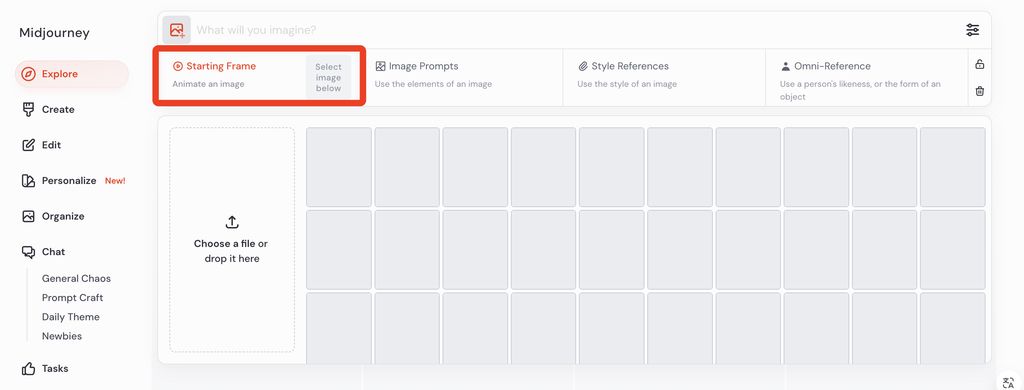

- 进入“Create”页面:登录后,所有创作活动都在 midjourney. Com/create 页面进行 12。

- 选择你的源图像:用户有两种方式选择源图像。可以直接从自己已有的Midjourney作品库中选择一张图片,或者将外部图片(如照片、其他AI生成的图像)从电脑拖拽到页面顶部的想象力输入框(Imagine bar)中进行上传 2。这种灵活性是V1的一大优势。

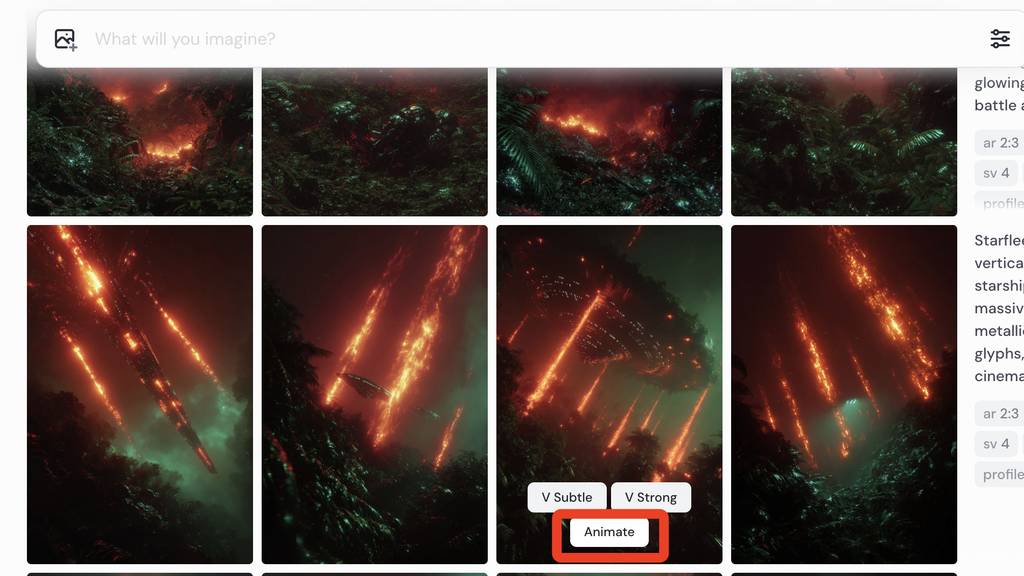

- 定位并点击“Animate”:选中一张图片后,其下方会出现“Animate”(动画化)按钮。点击此按钮即可启动视频生成流程 2。

- 生成与输出:Midjourney会根据源图像生成一个包含四种不同动态效果的视频网格,每个视频时长约为5秒 1。用户可以将鼠标悬停在每个视频上进行快速预览,以选择最满意的效果 6。

- 下载你的视频:选择一个视频后,用户可以进行下载。系统提供了两种下载选项:标准下载(Save video)和“为社交媒体保存”(Save for social)。后者使用了一种特殊的编码器,旨在优化视频在社交平台上的兼容性和播放效果 16。

表1:Midjourney Video v1核心功能一览

| 功能 | 描述 | 理想用途 |

|---|---|---|

| 工作流 | 仅支持图像到视频(I2V)。可动画化Midjourney生成图或外部上传图。 | 动画化现有艺术作品,让照片动起来。 |

| 平台 | 基于网页的界面 (midjourney. Com)。 | 所有视频生成任务。 |

| 初始输出 | 每次生成4个视频变体,每个约5秒长。 | 从一张图中探索多种动态可能性。 |

| 分辨率 | 480p标清。发布时无原生超分辨率功能。 | 社交媒体内容、概念艺术、循环动图。不适用于大屏幕商业制作。 |

| 音频 | 无。生成的视频均为静音。 | 需要在后期制作中添加音效的项目。 |

| 视频扩展 | 可将视频以约4秒为单位进行扩展,最多4次(总长约21秒)。 | 构建简短的叙事序列或更长的循环动画。 |

第三部分:掌控动态——动画提示词的艺术

从简单的自动生成迈向有意识的艺术创作,关键在于掌握如何通过提示词(Prompt)精确地指导动画。Midjourney Video v1为此提供了两层控制系统:动画模式和动态强度。

双重控制:动画模式与动态强度

- 动画模式(Animation Modes):

- 自动模式(Automatic):在此模式下,AI会为你自动生成一个“动作提示词”,让图像“动起来”。这是一种快速、有趣且充满惊喜的方式,适合初学者或寻求灵感的用户 1。

- 手动模式(Manual):此模式赋予用户完全的控制权,允许你通过编写详细的文本指令来描述物体如何移动、场景如何演变 1。这是实现精确艺术意图的核心。

- 动态强度(Motion Intensity):

- 低动态(Low Motion):最适合氛围场景、肖像或需要微妙动态的画面。在这种模式下,镜头通常保持静止,只有主体进行缓慢或细微的移动 2。其优点是能创造出自然、集中的动态效果,但缺点是有时可能导致画面几乎没有动静 2。

- 高动态(High Motion):最适合动作场面或需要主体与镜头同时运动的动态场景 2。其优点是能产生充满活力的视觉效果,但缺点是过多的运动有时会导致“古怪的错误”或视觉伪影(artifacts) 2。

手动提示词大师课:编写“微型故事”

要精通手动模式,需要转变思维方式。视频提示词并非像图像提示词那样罗列关键词,而是更接近于编写一个“3秒钟的微型故事” 7。一个有效的动作提示词应包含三个基本要素:

- 动作动词(Action Verbs):这是动态的基础。强有力的动词能直接传达运动意图。例如:walks (行走), turns (转身), rises (升起), glows (发光), flickers (闪烁), darts (飞奔), pans (平移), zooms (变焦), tilts (倾斜)。

- 时间连接词(Temporal Connectors):这些词汇用于构建动作序列。例如:then (然后), while (同时), suddenly (突然), after that (在那之后)。

- 场景进展(Scene Progression):描述场景本身如何演变。例如:from a forest to a glowing cave (从森林进入发光的洞穴), as the moon rises behind it (月亮在其后升起)。

通过解构一个专家级提示词的例子,可以更好地理解这三要素的结合:“A cat darts across a rooftop, while the moon rises behind it. Camera pans left as a streetlamp flickers.” (一只猫飞奔穿过屋顶,同时月亮在它身后升起。当一盏街灯闪烁时,镜头向左平移。) 7。这个提示词清晰地定义了主体动作(猫飞奔)、背景变化(月亮升起)和镜头运动(向左平移),为AI提供了明确无误的指令。

应避免的“安慰剂”与“噪音”提示词

在编写动作提示词时,应主动避免使用与视频动态无关的词汇,因为它们会成为“噪音”,干扰模型的理解。这包括:

- 分辨率术语,如 “8K”, “HDR” 7。

- 摄影参数,如 “f/1.8”, “50mm lens” 7。

- 艺术平台标签,如 “Artstation trending” 7。

这些在图像生成中可能有用的词汇,在视频模型中是无效的“安慰剂”。

表2:手动动作提示词最佳实践

| 推荐做法 ✅ | 避免做法 ❌ |

|---|---|

| 使用强烈的动作动词:A character walks towards the camera (一个角色走向镜头), smoke rises slowly (烟雾缓缓升起), lights flicker (灯光闪烁)。 | 仅使用静态形容词:beautiful, amazing, stylistic (美丽,惊艳,有风格)。这些描述的是状态,而非动作 19。 |

| 明确描述镜头运动:camera pans left (镜头向左平移), slow zoom in (缓慢拉近), tilt up to reveal the sky (向上倾斜镜头以展示天空)。 | 使用摄影参数:f/1.8, 50mm lens。视频模型不解析这些参数来控制动态 7。 |

| 用序列讲述一个微型故事:A car drives past, then a bird flies by (一辆车驶过,然后一只鸟飞过)。 | 罗列不相关的关键词:car, bird, street, cinematic (车,鸟,街道,电影感)。这缺乏清晰的时间顺序。 |

| 为5秒的片段专注于一个清晰的动作。 | 提示复杂的、多步骤的动作:A person stands up, walks to the door, opens it, and leaves (一个人站起来,走到门口,打开门,然后离开)。这对一个片段来说过于复杂。 |

| 保持提示词简洁并专注于动态。 | 包含“安慰剂”式的质量词:8K, ultra-realistic, HDR, Artstation trending。这些对视频模型是噪音 7。 |

第四部分:构建叙事——扩展片段与保持一致性

单个5秒的片段虽然有趣,但真正的创意潜力在于将它们串联成更长的叙事,并在此过程中保持视觉元素的一致性。

“扩展”功能:构建更长的序列

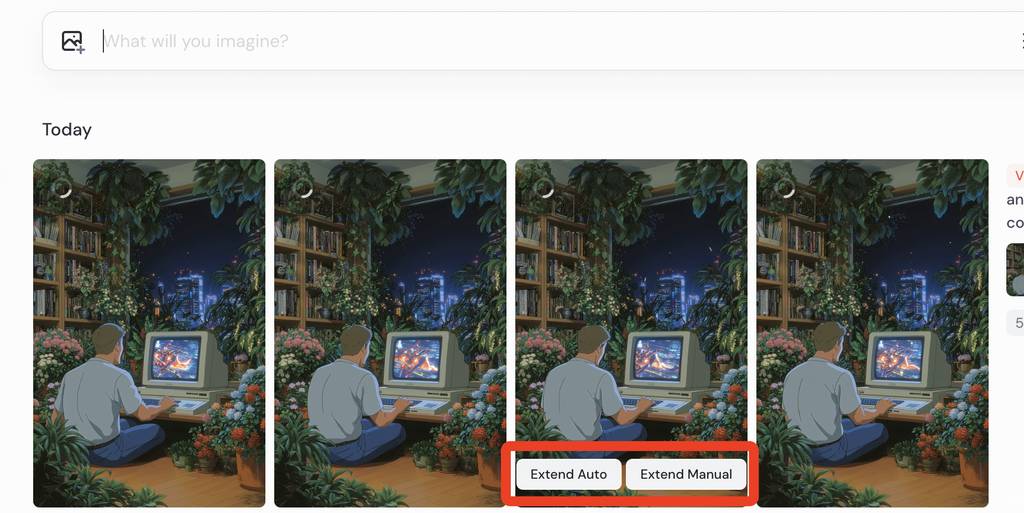

Video v1允许用户将选中的视频片段进行扩展。每次扩展会增加约4秒的时长,最多可扩展4次,从而将总时长延长至约21秒 1。这一功能有两种模式:

- 自动扩展(Extend Auto):使用原始的动作提示词继续生成后续动画 7。

- 手动扩展(Extend Manual):允许用户为下一个片段输入一个全新的提示词 7。这是推进叙事的强大工具。例如,你可以从一个角色注视着宇宙飞船的片段开始,然后使用“手动扩展”并输入提示词“the spaceship begins to lift off”(宇宙飞船开始升空),从而创造一个有情节发展的序列。

一致性大师课:一个“前期制作”工作流

Midjourney Video v1在单个扩展链中能很好地保持与其源图像的一致性。但如果你想在不同的场景中使用同一个角色,就会面临挑战,因为从不同源图像生成的视频片段之间缺乏内在的一致性。

解决这个问题的关键,在于采用一个非显而易见的两阶段生产流程。这个流程的核心思想是:在制作视频之前,先利用Midjourney强大的图像一致性工具来生成一套视觉上统一的“故事板”或“关键帧”。

使用—cref和—cw进行视频前期制作的分步指南:

- 创建你的“主角”图像:首先,通过 /imagine 命令生成你想要的角色或物体的初始“英雄”图像 23。

- 复制图像URL:获得这张英雄图像的直接链接地址 23。

- 使用—cref(角色参考):在一个新的 /imagine 提示词中,描述新场景的内容,并在末尾添加 —cref。这将强制新生成的图像在角色外观上与你的英雄图像保持一致 23。

- 使用—cw(角色权重)微调:通过添加 —cw [0-100] 参数来调整一致性的强度。—cw 100 会最大程度地保留角色的面部和服装,而较低的值(如 —cw 60)则允许服装等细节发生变化,同时保持面部特征不变 23。

- 生成你的“故事板”:重复步骤3和4,为你的故事中的每一个不同场景都生成一张风格和角色一致的静态图像。

- 逐一动画化图像:现在,你拥有了一系列视觉上连贯的静态图像。将这些图像逐一作为源图像,使用“Animate”功能来生成各自的视频片段。

- 拼接成片:最后,在视频编辑软件中将这些独立的、但角色一致的视频片段拼接起来,就完成了一个多场景的短片。

一个用户发现的高级技巧是,在 —cref 参数后重复使用同一个图像URL两次,可以进一步增强一致性 24。这种先制作一致性图像、再进行动画化的工作流,是解锁Video v1叙事潜能的关键所在。

第五部分:技术规格、成本与局限性

为了有效地利用Midjourney Video v1,用户必须了解其技术参数、成本结构和当前存在的局限性。

分辨率与质量

- 480p分辨率上限:Video v1目前输出的视频均为480p标清分辨率 7。这一看似保守的设定,是Midjourney为了优先保障生成速度和降低使用门槛而做出的战略选择,而非技术上的失败 7。

- 无原生超分功能:在发布初期,模型本身不提供将视频分辨率提升的功能 9。如果需要更高清的画质,用户需要借助第三方软件,如Topaz Video AI,进行后期处理 22。

成本与GPU消耗

- 8倍成本系数:一次视频生成任务所消耗的GPU时间(Fast Minutes)大约是生成一张标准图像的8倍 1。

- 每秒成本分析:尽管成本系数较高,但其性价比出奇地高。因为一次任务会产出四个5秒的视频,平摊下来,生成每秒视频的成本大约只相当于一次图像放大(upscale)的成本,或“一张图的成本” 2。据官方称,这比市场上一些现有方案便宜了超过25倍 2。

- 订阅套餐与“Relax Mode”:成本管理与用户的订阅套餐紧密相关。

- 基础套餐($10/月):用户会很快耗尽其有限的“Fast” GPU分钟数,这对于视频创作来说限制较大 8。

- 专业版($60/月)与超级版($120/月):这两个套餐的用户可以使用视频的“Relax Mode”。在此模式下,视频生成任务会在较低优先级队列中处理,速度较慢,但不消耗任何GPU分钟数,实现了无限量的视频生成 1。对于任何希望深入探索和掌握Video v1的创作者来说,“Relax Mode”并非奢侈品,而是一项几乎必不可少的功能,因为它移除了因反复试验而产生的高昂成本障碍。

当前局限性

- 无声音:所有生成的视频均为静音 1。

- 无高级编辑功能:目前缺乏如遮罩(masking)、局部重绘(inpainting)或直接的文本到视频(T2V)等高级编辑工具 9。

- 动态伪影:在高动态模式下,可能会出现肢体扭曲、背景变形或抖动等视觉伪影。复杂的物理交互(如物体碰撞)也可能处理得不够理想 7。

第六部分:战略应用与结论——Midjourney Video v1适合你吗?

综合以上分析,Midjourney Video v1并非一个万能的视频工具,而是一款具有明确目标和独特优势的创新产品。它的价值在于其独特的定位和对特定用户群体的深刻理解。

Video v1的理想用例

基于其在美学品质、I2V工作流和循环动画方面的优势,Video v1特别适用于以下场景:

- 艺术短片与动画循环:创造具有梦幻、手绘或超现实风格的视觉作品 6。

- 动态概念艺术与故事板:快速将静态概念动态化,用于视觉探索和方案演示 6。

- 音乐可视化与氛围背景:其出色的美学和循环特性非常适合为音乐或环境创建动态背景 6。

- 独特的社交媒体内容:制作引人注目的、风格独特的GIF动图和短视频 6。

在竞争格局中的定位

将Video v1与其主要竞争对手进行比较,可以更清晰地看到其独特的价值主张。

- Midjourney V1:其核心优势在于美学与风格的延续性。它是一款为庞大的Midjourney艺术家社群量身定制的工具,让他们能以自己熟悉的标志性风格轻松地将作品动画化 6。

- OpenAI Sora:优势在于照片级真实感、物理模拟和长叙事潜力。它是一款旨在实现电影级故事叙述的T2V工具 6。

- Runway (Gen-3):优势在于精细的控制和功能丰富的编辑套件。它为需要全面工具集和高级相机控制的专业创作者提供了强大的平台 9。

- Pika Labs:优势在于角色一致性和易用性。它以用户友好的界面和强大的角色动画功能而闻名 9。

表3:主流AI视频模型对比分析

| 模型 | 主要工作流 | 核心优势 | 目标用户 |

|---|---|---|---|

| Midjourney V1 | 图像到视频 (I2V) | 美学与风格一致性。以其标志性艺术风格动画化图像。 | 现有Midjourney艺术家,专注于风格和视觉循环的创作者。 |

| OpenAI Sora | 文本到视频 (T2V) | 真实感与叙事连贯性。模拟物理以生成长篇、电影感场景。 | 寻求高保真、写实输出的电影制作人和故事讲述者。 |

| Runway (Gen-3) | T2V & I2V | 精细控制与编辑套件。提供高级功能和相机控制。 | 需要完整工具集的专业创作者和视觉特效艺术家。 |

| Pika Labs | T2V & I2V | 角色一致性与易用性。用户友好,具有强大的角色动画功能。 | 社交媒体创作者,优先考虑在不同场景中保持角色一致性的用户。 |

结论:一个入口,而非终点

Midjourney Video v1并非试图成为市场上功能最全面的视频编辑器。它的本质是一个“通往想象力的传送门” 7。它的推出,代表着一种从静态创作到动态体验的根本性转变。

对于那些已经沉浸在Midjourney独特美学世界中的创作者而言,V1提供了一个无与伦比的工具,让他们能够以最低的学习成本将想象力延伸到新的维度。它不是终点,而是Midjourney迈向构建互动式、AI生成世界的宏大旅程的第一步 2。对于认同这一愿景、并将艺术风格置于首位的创作者来说,Video v1无疑是一个激动人心且充满潜能的新起点。

想获取更多 AI 辅助设计和设计灵感趋势? 欢迎关注我的公众号(设计小站):sjxz00。

Works cited

- Midjourney launches V1: AI video generator now available to all users, accessed June 26, 2025, https://www.thehansindia.com/tech/midjourney-launches-v1-ai-video-generator-now-available-to-all-users-981176

- Introducing Our V1 Video Model - Midjourney, accessed June 26, 2025, https://updates.midjourney.com/introducing-our-v1-video-model/

- Midjourney Unveils V1: A Foray Into AI-Driven Video Generation - The Future Media, accessed June 26, 2025, https://thefuturemedia.eu/midjourney-unveils-v1-a-foray-into-ai-driven-video-generation/

- Midjourney Launches Its First Video Model ‘V1’ | ml-news – Weights & Biases - Wandb, accessed June 26, 2025, https://wandb.ai/byyoung3/ml-news/reports/Midjourney-Launches-Its-First-Video-Model-V1---VmlldzoxMzI4MDA3Mw

- Midjourney launches AI video model. How to try V1, how much it costs. - Mashable, accessed June 26, 2025, https://mashable.com/article/midjourney-v1-ai-video-generator

- Midjourney Video V1 Is Here! How Does It Compare to Google Veo 3 & OpenAI Sora?, accessed June 26, 2025, https://felloai.com/2025/06/midjourney-video-v1-is-here-how-does-it-compare-to-google-veo-3-openai-sora/

- Midjourney Video Tutorial & Analysis: Why It May Transform Future Creation, accessed June 26, 2025, https://midjourneysref.com/guide/Mastering-Midjourney-Video

- Midjourney launches V1, its first AI video model - Cosmico, accessed June 26, 2025, https://www.cosmico.org/midjourney-launches-v1-its-first-ai-video-model/

- Midjourney’s First Video Model: A Strategic Beta for the Generative Future - SmythOS, accessed June 26, 2025, https://smythos.com/ai-trends/midjourneys-first-video-model/

- Midjourney V1 Video Model: Will The Art-First AI Challenge Other AI Video Generation Giants? - DeeVid AI, accessed June 26, 2025, https://deevid.ai/blog/midjourney-v1-video-model-will-the-art-first-ai-challenge-other-ai-video-generation-giants

- Midjourney Enters Text-to-Video Space with New V1 Model – Priced for Everyone - Reddit, accessed June 26, 2025, https://www.reddit.com/r/AINewsMinute/comments/1lf2axz/midjourney_enters_texttovideo_space_with_new_v1/

- Getting Started Guide – Midjourney, accessed June 26, 2025, https://docs.midjourney.com/hc/en-us/articles/33329261836941-Getting-Started-Guide

- Midjourney Debuts V1 AI Video Model - InfoQ, accessed June 26, 2025, https://www.infoq.com/news/2025/06/midjourney-v1-video/

- Midjourney’s Video Model is here! - Reddit, accessed June 26, 2025, https://www.reddit.com/r/midjourney/comments/1lemxxm/midjourneys_video_model_is_here/

- Midjourney Video V1: A Comprehensive Guide to AI Video Generation, accessed June 26, 2025, https://www.toolify.ai/ai-news/midjourney-video-v1-a-comprehensive-guide-to-ai-video-generation-3549101

- How To Create AI Video With Midjourney - YouTube, accessed June 26, 2025, https://www.youtube.com/watch?v=_noOd2qF7Jc

- MidJourney Video Model V1 is Here – Full Tutorial (Step-by-Step Guide + Results), accessed June 26, 2025, https://www.youtube.com/watch?v=uXqwkjS90dw

- I Tried Midjourney’s AI Video Generator, and It’s Better Than I Expected | Lifehacker, accessed June 26, 2025, https://lifehacker.com/tech/midjourney-ai-video-generator-better-than-expected

- Guide: How to Build the Best Midjourney Web Designs - Reddit, accessed June 26, 2025, https://www.reddit.com/r/midjourney/comments/10htgrv/guide_how_to_build_the_best_midjourney_web_designs/

- Midjourney Video V1: A New Frontier in AI-Generated Animation | flux-ai. Io, accessed June 26, 2025, https://flux-ai.io/blog/detail/Midjourney-Video-V1-A-New-Frontier-in-AI-Generated-Animation-10607a05adc2/

- MidJourney Video V1 Is Insane! | Full Tutorial: Auto & Manual Animation - YouTube, accessed June 26, 2025, https://www.youtube.com/watch?v=aXSku9_ZfKs

- Midjourney VIDEO Takes Over – Animate. Extend. Repeat. (Update 2025) - YouTube, accessed June 26, 2025, https://www.youtube.com/watch?v=Eud6Qp755_E

- How to use MidJourney’s new consistent character feature | Tom’s …, accessed June 26, 2025, https://www.tomsguide.com/ai/ai-image-video/how-to-use-midjourneys-new-consistent-character-feature

- Midjourney video is really fun - Reddit, accessed June 26, 2025, https://www.reddit.com/r/midjourney/comments/1lf8xac/midjourney_video_is_really_fun/

- Midjourney V1 Video Model: Complete Guide, Review & Better Alternative - Dreamina, accessed June 26, 2025, https://dreamina.capcut.com/resource/midjourney-v1-video-model

- Did Midjourney Video Cook? The Ultimate Review! - YouTube, accessed June 26, 2025, https://www.youtube.com/watch?v=8ZNwXfGFXU4

- Loop It Like It’s Hot: MidJourney Video to GIF for Bloggers & Creators | by Meri CreativAI, accessed June 26, 2025, https://medium.com/@mericreativAI/loop-it-like-its-hot-midjourney-video-to-gif-for-bloggers-creators-7598ef9e848f

- Which AI video tool is best? ULTIMATE COMPARISON! - YouTube, accessed June 26, 2025, https://www.youtube.com/watch?v=A6sAR70Q07Y

- I’ve spent 200 hours testing the best AI video generators — here’s …, accessed June 26, 2025, https://www.tomsguide.com/features/5-best-ai-video-generators-tested-and-compared

- The BEST AI VIDEO Generator is… (Head-to-Head Comparison), accessed June 26, 2025, https://midjourney.fm/blog-The-BEST-AI-VIDEO-Generator-is-HeadtoHead-Comparison-35677