5分钟阅读

Obsidian+Khoj AI设计师的第二大脑!

前言

很久没有写过语言大模型辅助设计的相关文章了,之前写过一起关于设计师如何做知识管理的,感兴趣的朋友可以回顾一下:# 【AI辅助设计】AI时代设计师如何管理自己的知识?

这期我们尝试探讨Obsidian+Khoj AI,引入AI大模型,打造一个集个人知识加问答和管理的“个人第二大脑”。

Obsidian介绍

首先介绍一下这个工具,如果设计师们有了解,且已经在使用了,可以跳过哈。 Obsidian是一款功能强大的笔记和知识管理工具,专为需要高效组织和处理大量信息的用户设计。它利用Markdown格式,允许用户创建、编辑和链接笔记,从而形成一个高度互联的知识网络。以下是Obsidian的一些主要特点和功能:

-

Markdown支持:Obsidian使用Markdown语法,这使得文本编辑变得简单且灵活。Markdown是一种轻量级的标记语言,广泛用于格式化文本。

-

双向链接:用户可以轻松地在笔记之间创建双向链接,这样可以形成一个复杂的知识图谱,方便信息的交叉引用和关联。

-

图谱视图:Obsidian提供图谱视图,用户可以直观地看到所有笔记及其相互关系,帮助更好地理解和管理知识网络。

-

插件系统:Obsidian有一个强大的插件系统,允许用户根据自己的需求扩展功能。社区开发了大量插件,覆盖从任务管理到日历集成等各种功能。

-

本地存储:所有笔记都存储在本地文件系统中,这意味着用户完全掌控自己的数据,且数据安全性和隐私性更有保障。

-

多平台支持:Obsidian支持Windows、macOS和Linux等多个操作系统,用户可以在不同设备上无缝工作。

-

自定义:用户可以通过CSS自定义Obsidian的外观和感觉,打造符合自己喜好的工作环境。

-

离线工作:Obsidian可以完全离线运行,这对那些需要在没有互联网连接的环境中工作的用户非常有用。

Obsidian适用于各种用户群体,包括学生、研究人员、作家、程序员和知识工作者等。它的灵活性和强大的功能使其成为个人知识管理(PKM)领域的一个重要工具。

我用于日常写文档,写文章,剪藏文章,都是在Obsdian中,感觉我已经离不开他了 🥱~

这里还是多唠叨一句,本地优先的重要性,之前Notion(笔记应用的当红炸子鸡!)被爆云端数据出了问题,导致不少用户流失。

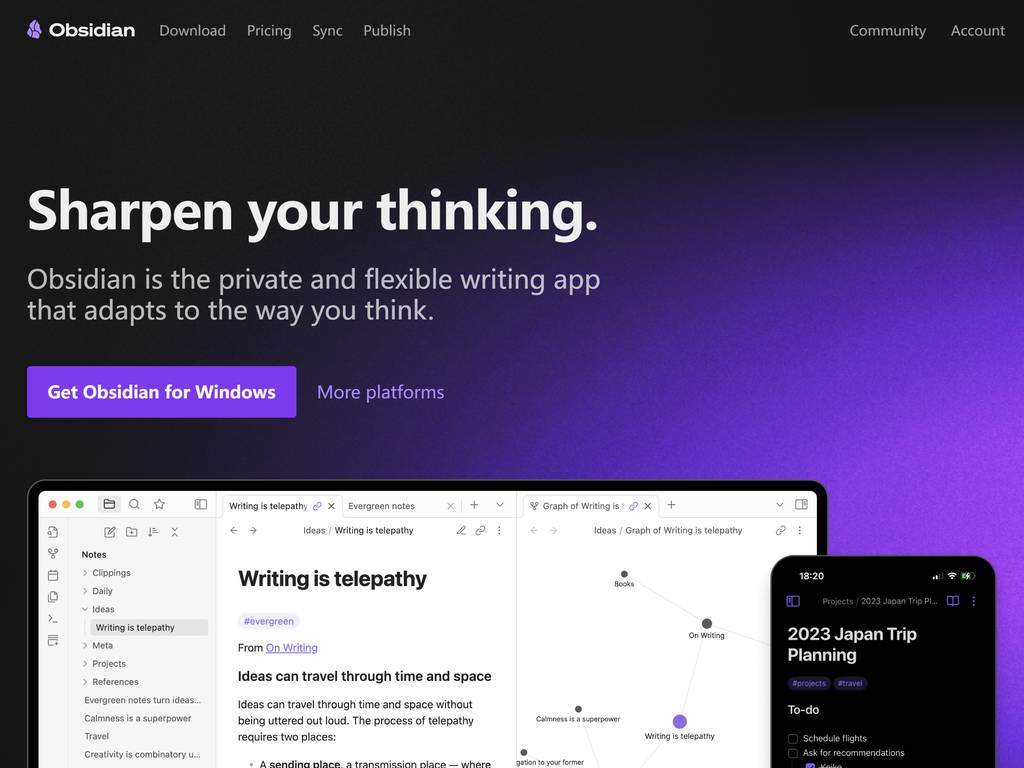

当然,本地优先并不是说不能云同步,Obsdian的强大之处,还在于拥有丰富的插件,通过安装插件,可以跟服务器进行同步,做到本地和多设备协同。

例如,我就是使用Self-hosted LiveSync这个插件,然后在Nas上,搭建了一个数据库服务,做到了多端同步。

总之好处还是很多的,建议大家用起来!

Khoj AI介绍

现在介绍一下Khoj AI。

Khoj是一个开源的个人AI

- 你可以与它聊任何话题。当相关时,它会使用你分享给它的文件来回应。

- 使用自然语言快速找到相关的笔记和文档。

- 它能够理解pdf、纯文本、markdown、org-mode文件、notion页面和github仓库。

- 你可以通过Emacs、Obsidian、Web浏览器或Khoj桌面应用访问它。

- 使用云服务随时随地访问你的Khoj,或者在消费级硬件上自托管以保护隐私。

Obsdian插件功能

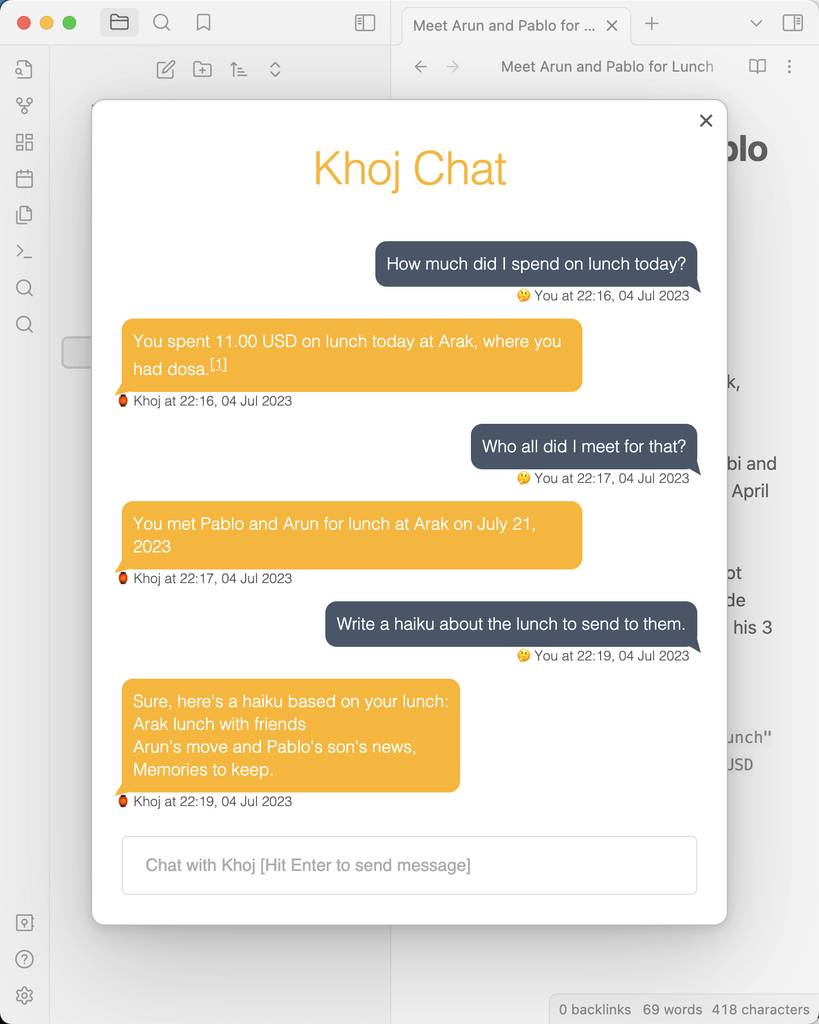

聊天

- 快速回答:从你的私人笔记或公共互联网中快速找到答案。

- 辅助创作:顺畅地在获取答案和生成内容之间切换。

- 迭代发现:迭代地探索和重新发现你的笔记。

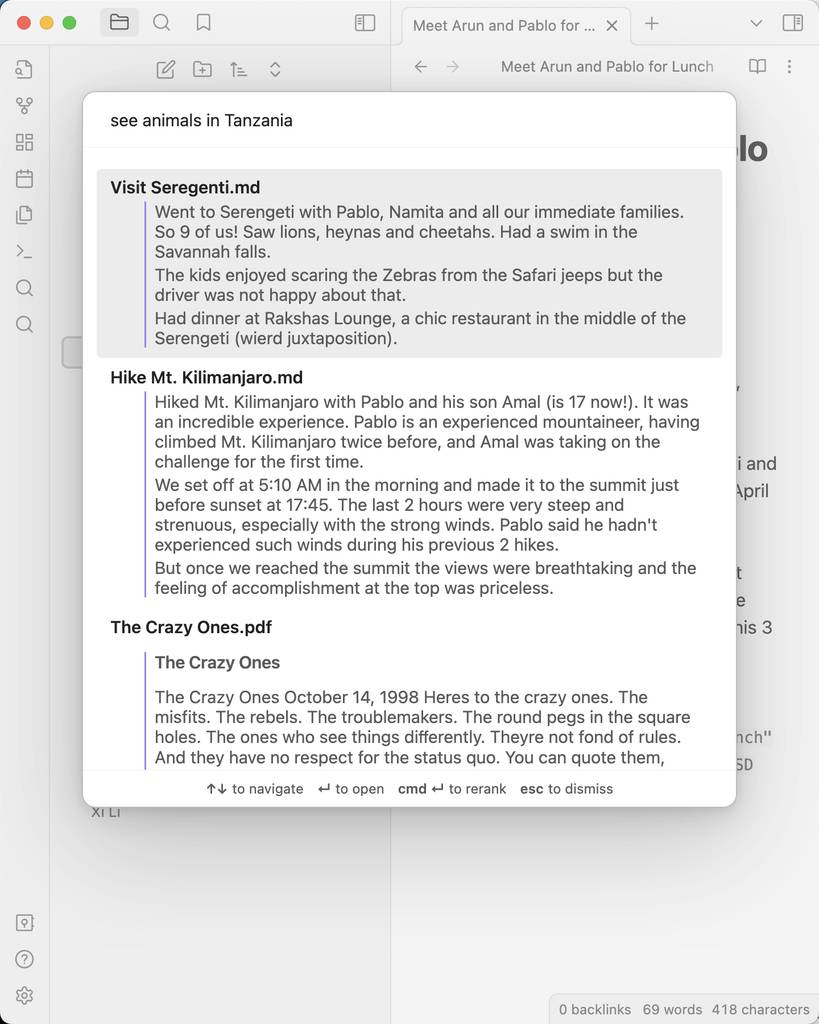

搜索

- 自然:使用基于Transformer的机器学习模型进行高级自然语言理解。

- 增量:增量搜索,提供快速的实时搜索体验。

安装&使用

Obsdian的安装与使用,我就不再赘述了,大家可以自行搜索教程,本文重点介绍Khoj的安装和使用。 安装过程虽然需要一定的代码基础,但是一步步跟着来,不会有问题的。

还是那句话,AI时代,设计师需要懂点代码,这样才不吃亏!

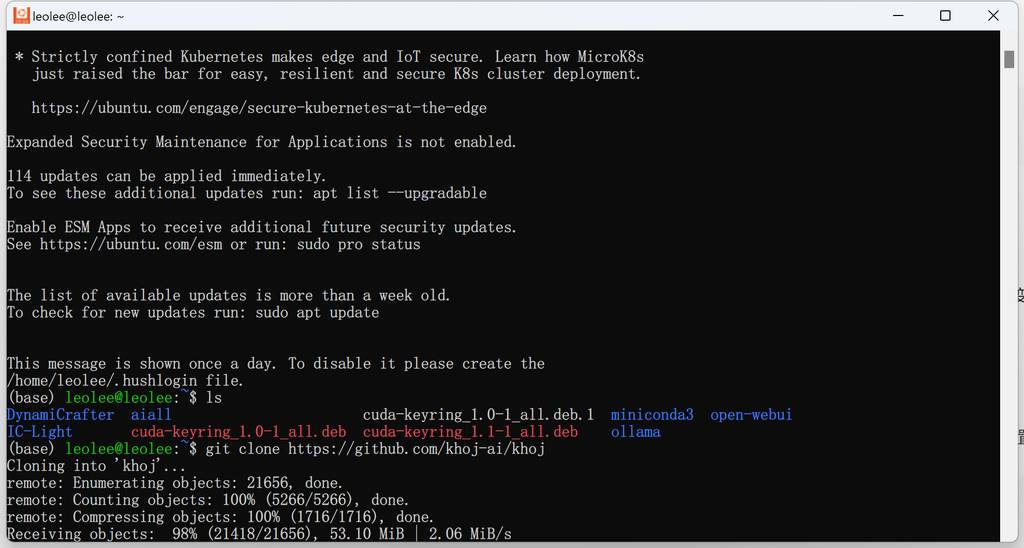

安装Khoj(Docker)

当然,您可以直接使用Khoj的云服务版本,但是秉承“我的数据我掌控”的核心理念,我们还是选择私有化部署。

前提条件

拉取代码

git clone https://github.com/khoj-ai/khoj

设置环境变量

使用Github中的示例docker-compose文件在Docker中运行Khoj。首先配置所有环境变量,根据你的需要进行选择。你的管理员账户将基于该文件中的管理员凭据自动创建,因此请注意这些信息。

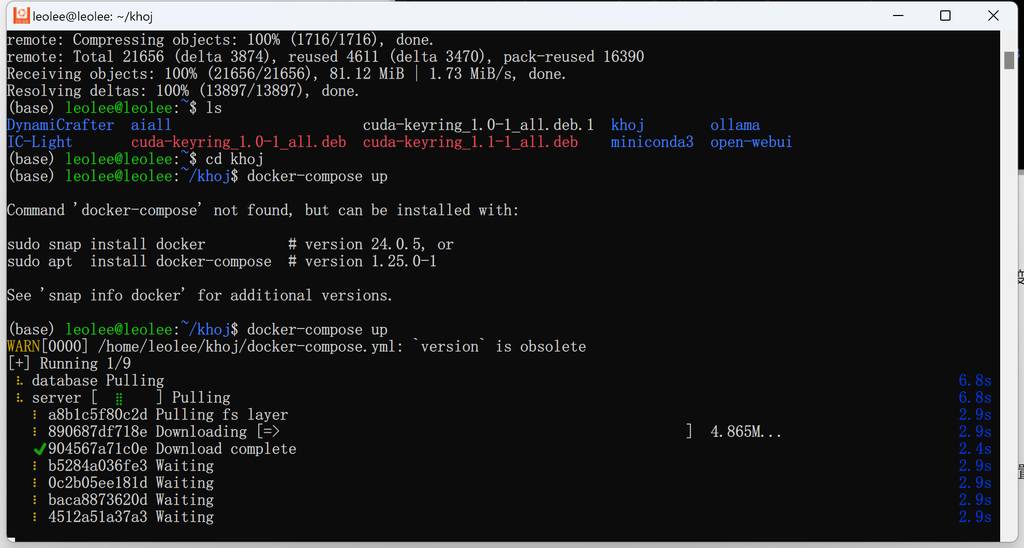

启动容器

要启动容器,请在docker-compose.yml文件所在的目录中运行以下命令。这将自动设置数据库并运行Khoj服务器。

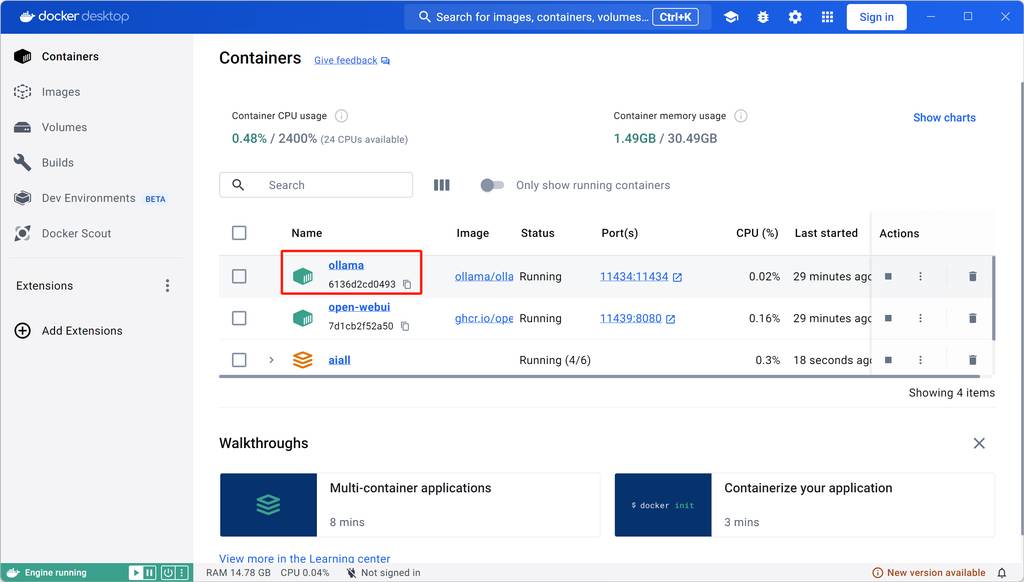

需要注意的是,此时要启动

docker desktop。 还有就是,要魔法环境~🥱

cd khoj

docker-compose up

这时候,系统会拉取镜像并进行安装,我们等待即可。

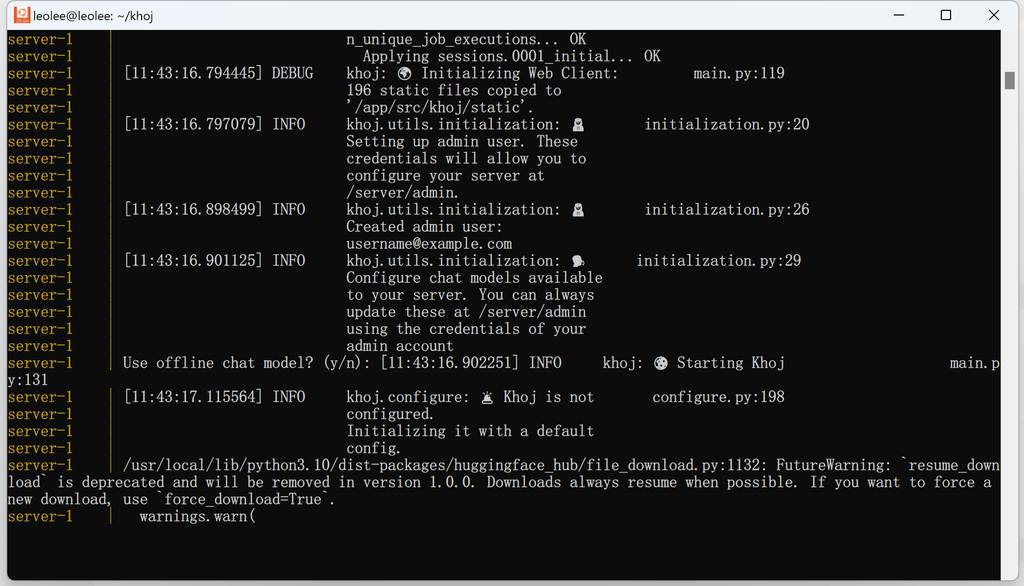

当看到这个界面,表示已经成功了。

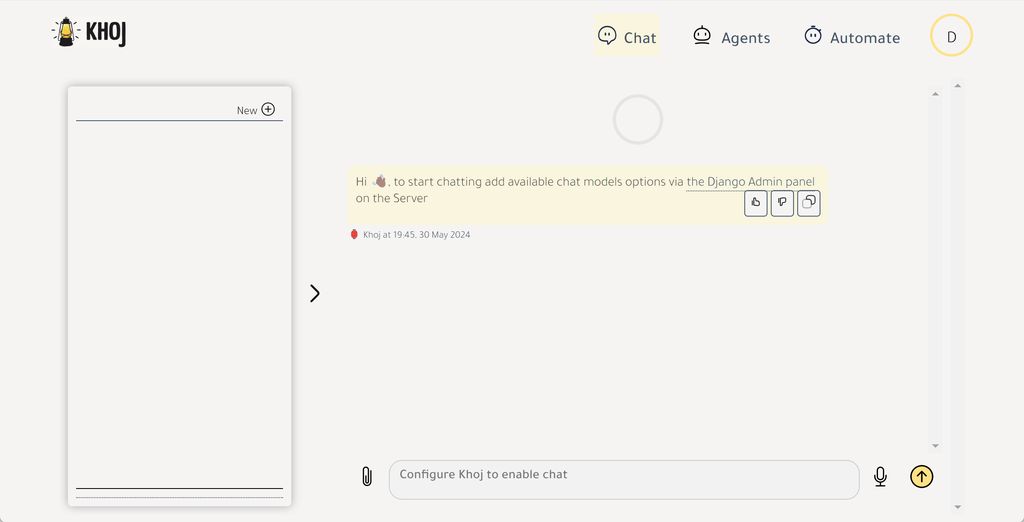

打开http://localhost:42110/,就可以访问前端页面。但在使用前,还需要进行设置。

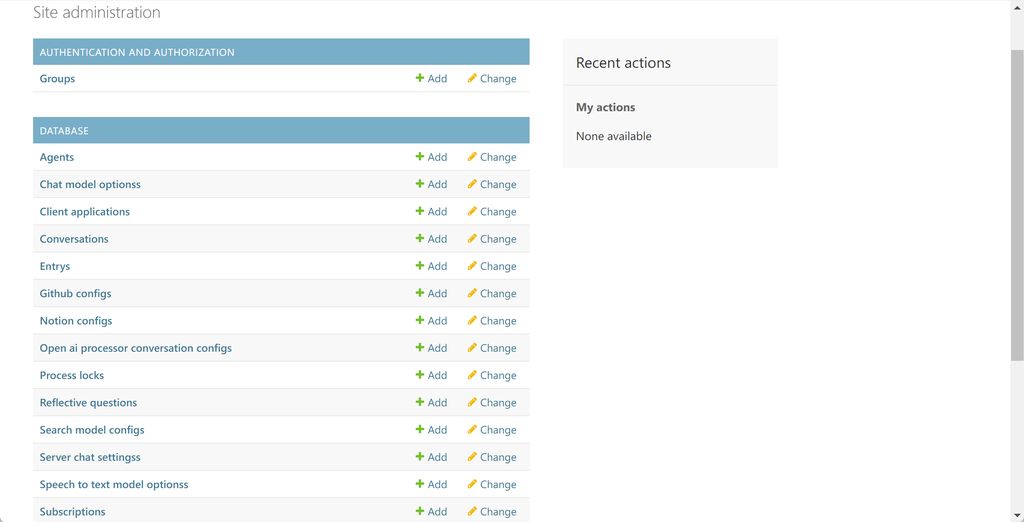

访问:http://localhost:42110/server/admin/,进行模型等设置。

Ollama设置

Ollama是一个开源模型管理平台,支持本地部署,在使用Khoj前,我们需要设置Ollma,这是为了保证知识100%本地化。

以下是使用Ollama平台的设置步骤指南:

-

下载Ollama:

- 访问Ollama的官方网站:https://ollama.com/

- 在首页找到下载部分。

- 选择适合您的操作系统的版本:macOS、Linux或Windows(预览版)。

-

安装Ollama:

- 下载完成后,按照提供的安装说明在您的计算机上安装应用程序。

-

运行模型:

- 打开终端或命令提示符。

- 导航到Ollama安装的目录。

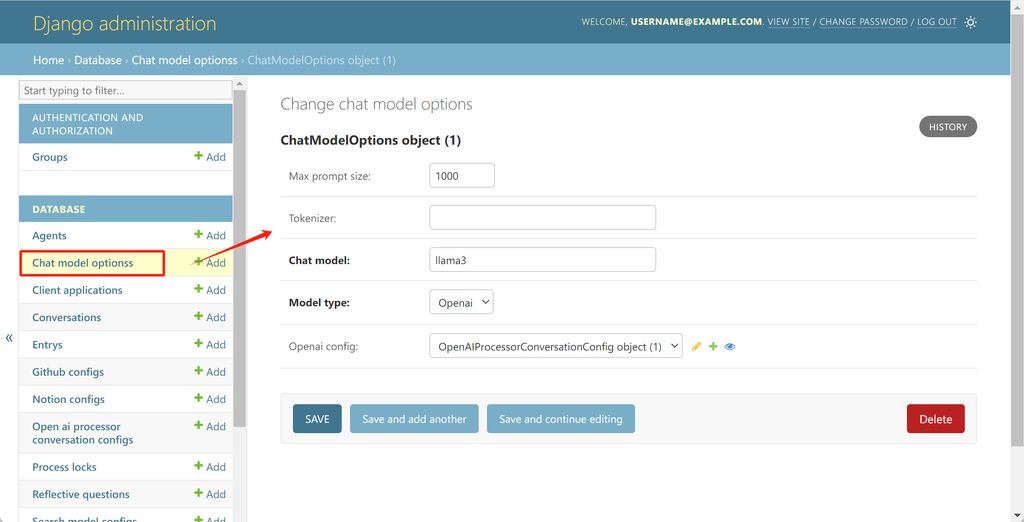

- 通过运行以下命令来启动您喜欢的模型:

ollama run llama3 - 如果使用的模型名称不同,请将

llama3替换为您希望使用的模型名称。

-

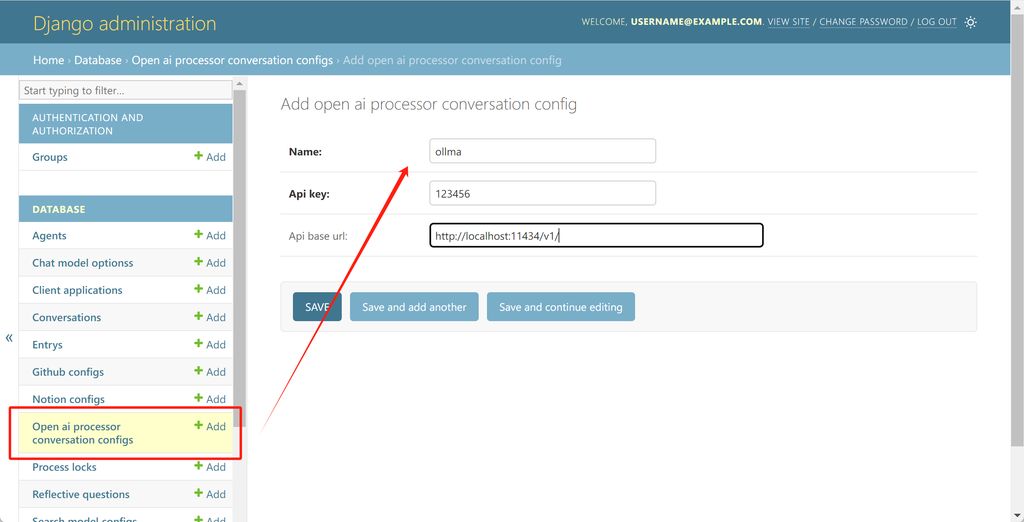

配置Khoj设置:

- 打开Ollama应用程序。

- 在OpenAI处理器部分寻找设置或配置部分。

- 在Khoj配置下找到“对话配置”或类似的设置。

安装好Ollma后,在deocker容器中,你应该可以看到这样:

Khoj设置

我们回到Khoj。

设置ollama:

设置聊天模型:

然后,回到前端页面,这时候就可以进行聊天了。

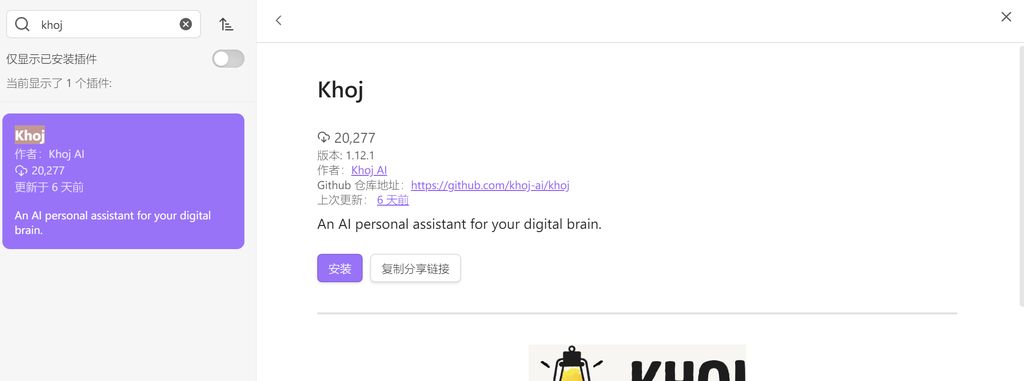

安装Khoj Obsdian插件

在插件市场搜索Khoj,即可进行安装。

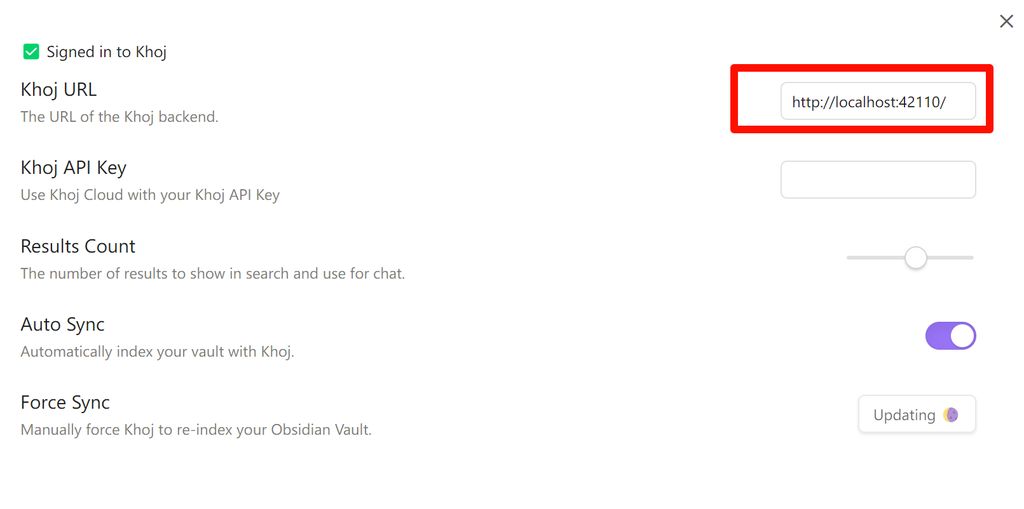

设置插件,这里填上自己部署的地址:

开始使用

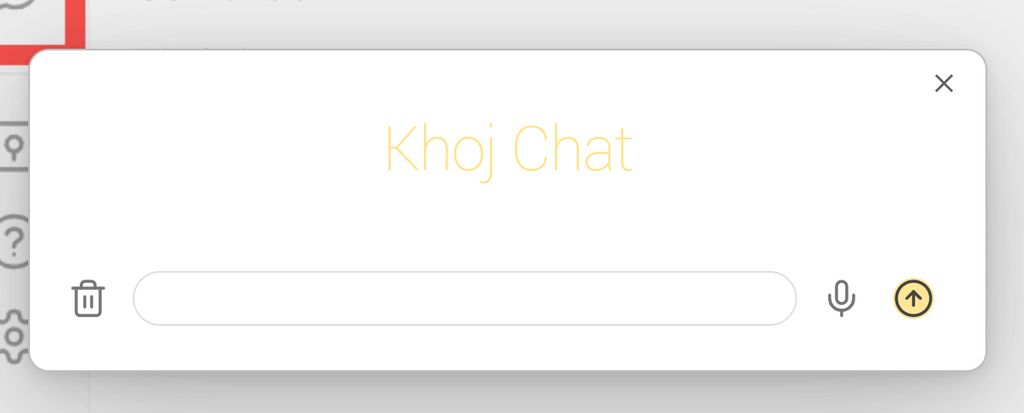

一切就绪后,我们试一下。 在Obsdian左侧栏,点击这个图标:

就可以看到对话框了。

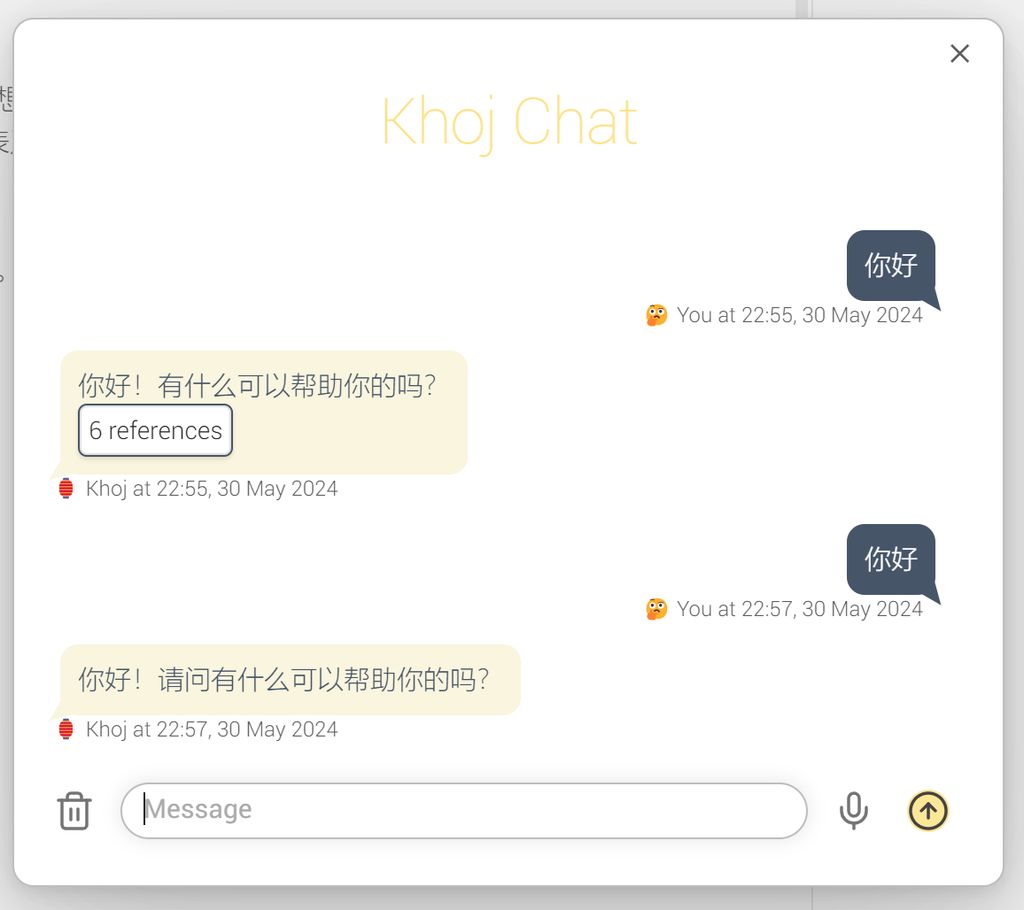

可以进行对话了。

会跟我的笔记进行联动,效果不错👍。

回答还带有关联的笔记。

可以总结我的笔记:

可以总结我的笔记:

总得来说,这套方案作为我的第二大脑,效果还是不错的 👍,大家可以试试!

好了,关于AI生成3D资产的介绍就到这里,有什么疑问或者问题,可以留言交流哦~ 关注我公众号(设计小站):sjxz00,获取更多AI辅助设计和设计灵感趋势。