5分钟阅读

尝试复刻Magnific的Relight功能

前言

设计小站一直关注Magnific AI 这家公司的产品,因为我感觉他们就是AIGC时代的“刺客”。

为什么这么说?第一,当别人家都在研究如何生成图像时,他就往图片尺寸和质量方向想,首次推出了在线放大图片的功能,至今还没有找到第二家能打的。第二,这个公司刚成立只有两个人,而实际营收确超越了一众AI公司。

最近他们又灰度了一个功能,叫Relight,可以将任意物体换背景,融合度非常好,又遥遥领先了👋。

其实关于换背景,无论是我们还是网络上的关注AIGC的各路大神们,都有过类似的ComfyUI工作流,即使我们结合了IC-Light技术,也未能达到Magnific的这种高度。感兴趣的小伙伴可以回顾一下过往的文章:

开源方案遇到的问题

使用ComfyUI搭建的工作流,过往一直存在这些问题:

- 光线融合不够好。这时候如果再次采样后,又会对主体产生破坏。

- 接入IC-Light的问题。通过接入IC-Light,可以一定程度上解决光线融合的问题,但是因为该技术是建立在SD1.5上的,图片的精度不够高,如果后面介绍放大流程,又对主体进行破坏🥷。还有,接入IC-Light,出图的某些图像整体会变暗,需要PS加工,产品的变色也严重。

- 文字问题。文字是最难搞的,除非SD3全面可以应用。但是我们看到Magnific也只是从一定程度上解决,其实没完全解决。

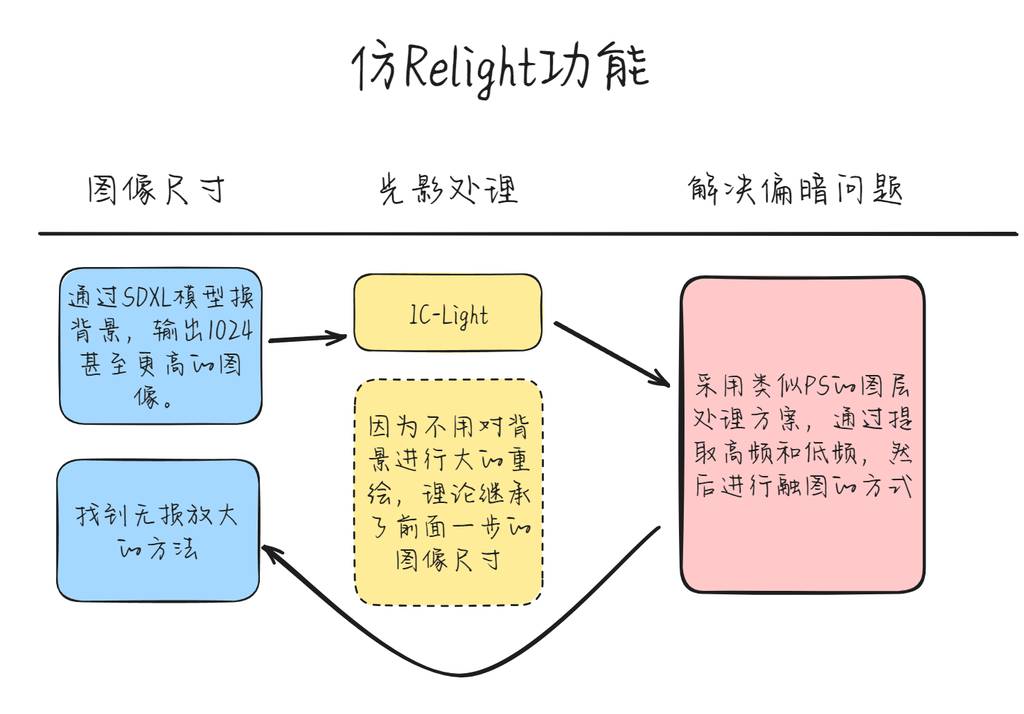

解决思路

既然Magnific开了个头,我们不妨尝试一下从ComfyUI流程上解决,以下是我的思路。

看看效果

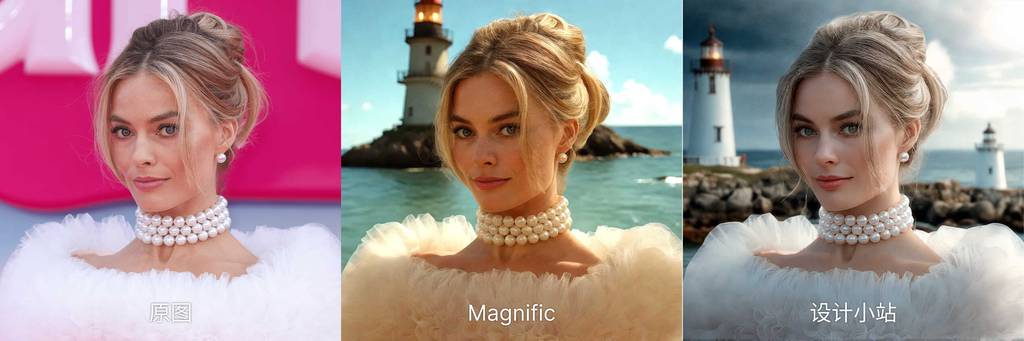

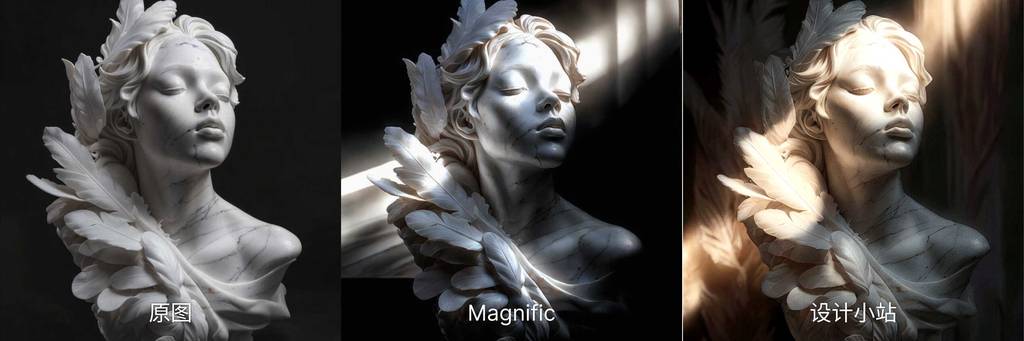

说那么多,方法有没有效果呢?还是先以效果说话。我直接采用了Magnfic官方的测试图,一起对比一下。

海边的女人

不知道为啥,通过反推后,背景提示语变成阴天了🤦♂️。

霓虹灯1

懒得去写背景的提示词了,氛围感还是不错的,主要看光线的关系哈~

霓虹灯2

光线的明暗和位置,其实可以通过绘制蒙板控制的。

小狗

提示词没写好,小狗没在水下~🤦♂️

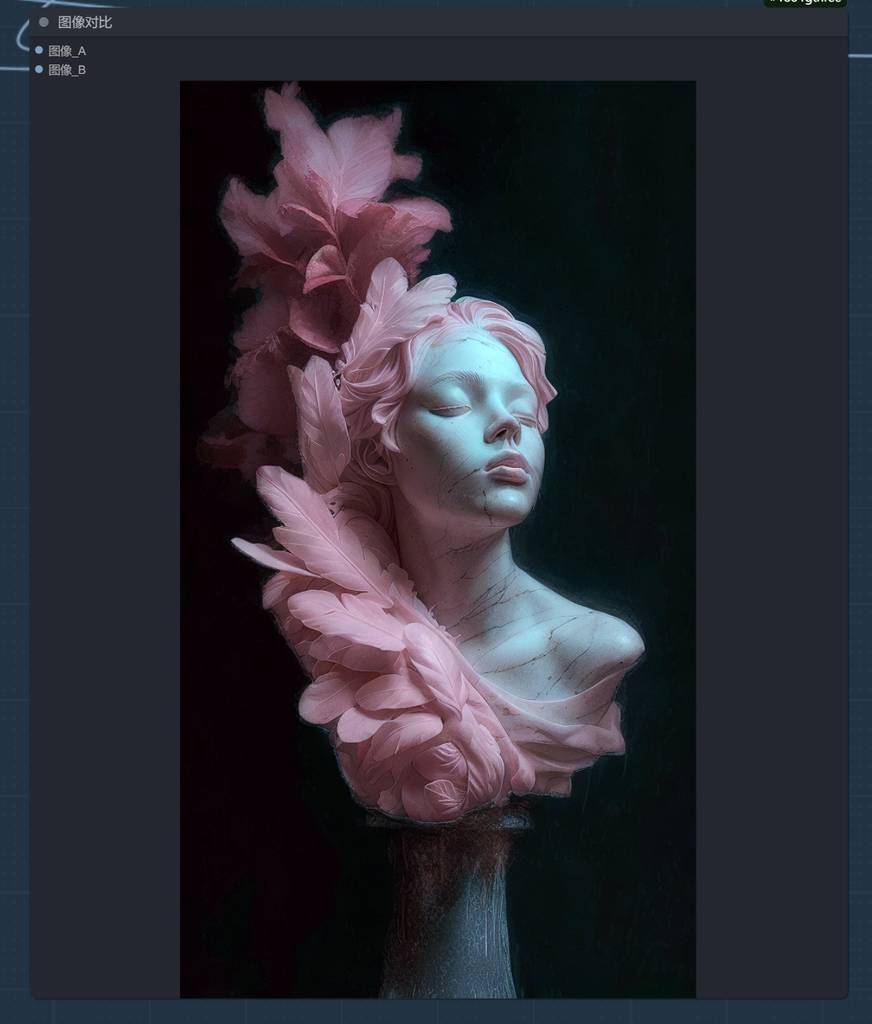

博物馆雕塑

再看看图片的精度方面:

感觉还是能打的呢~。

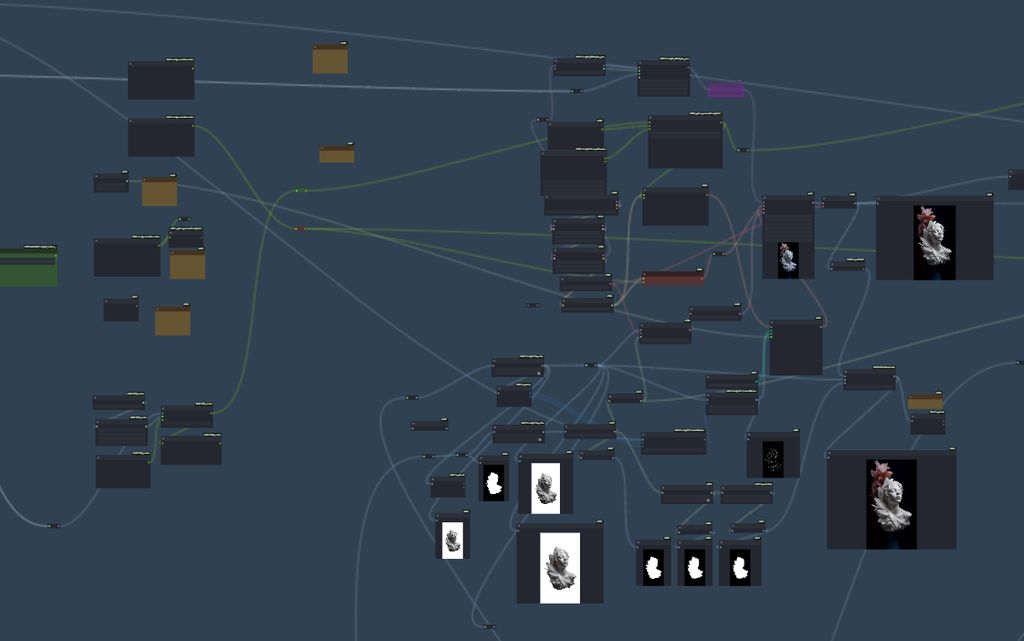

工作流讲解

换背景模块

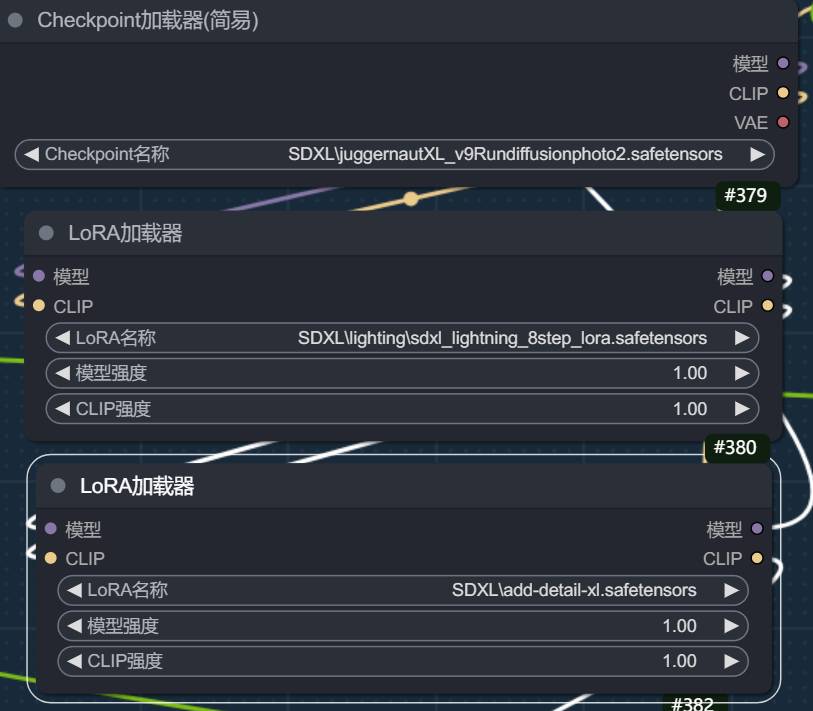

换背景模块直接看我之前的文章即可,【AI辅助设计】AI出效果图优化版流程 这里不能直接使用Brushnet的解决方案,因为基于SD1.5的生成的图片细节明显不够,作为背景就差点意思。

大模型选择如下,大了Lightning的LoRA加速出图。

IC-Light模块

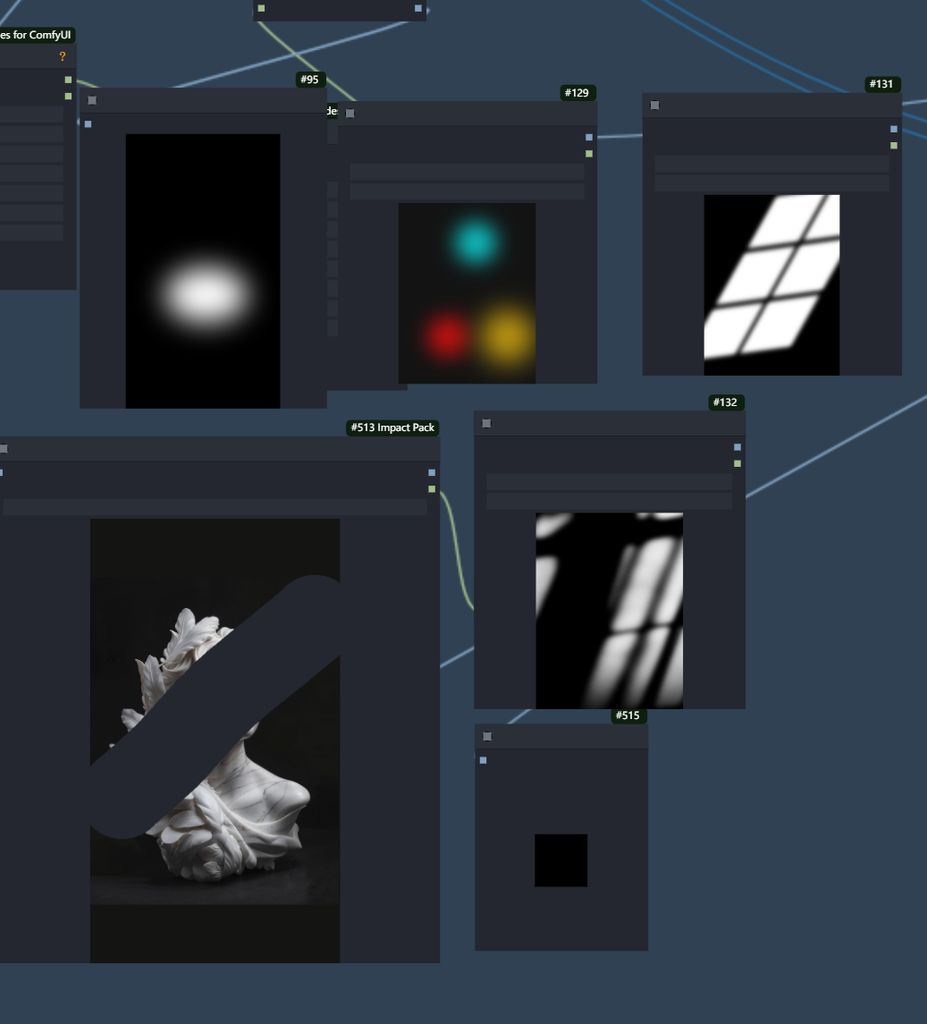

光线绘制

光线可以通过导入图片或者直接手绘蒙板方式。

IC-Light核心模块

这是官方的工作流,这里不多介绍了。

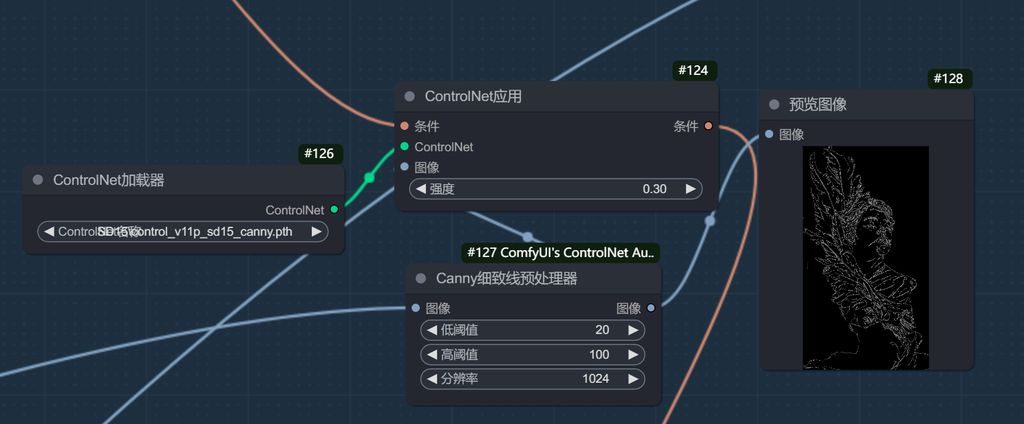

另外,如果需要对形态进行更精准的控制,可以加上一个canny控制。

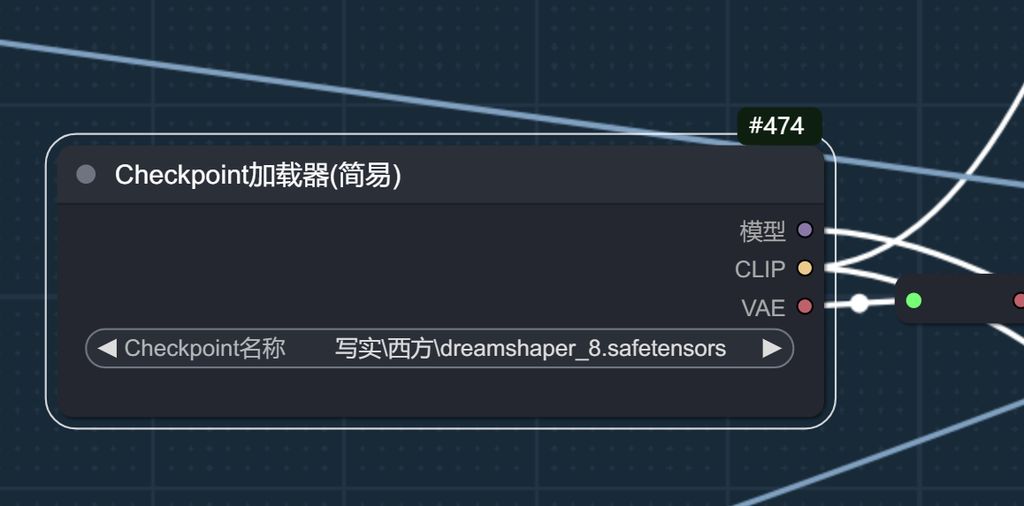

重点来了,IC是基于SD1.5的,所以这个模块使用的大模型必须使用SD1.5的模型。

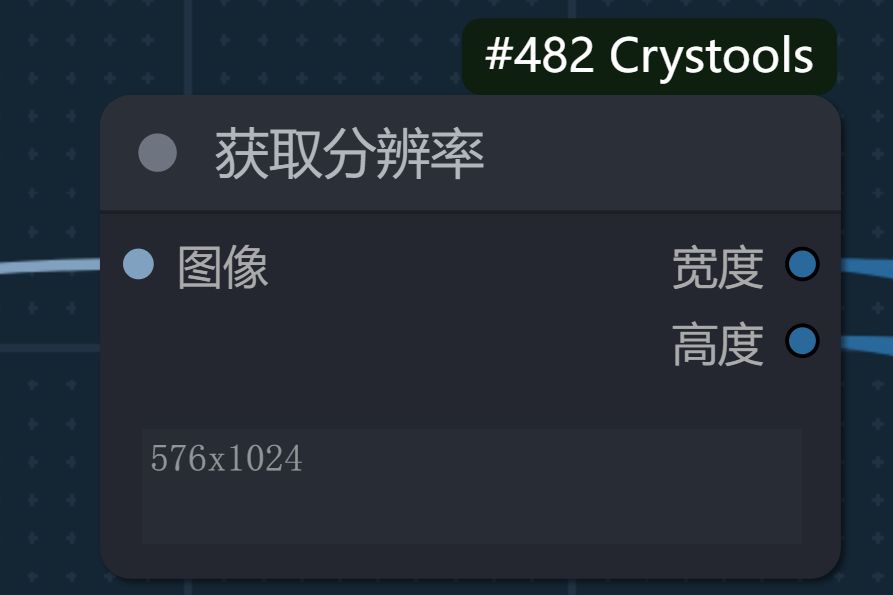

又因为底层是图生图原理,所以,Laten的尺寸,使用第一步生成的尺寸即可,就是SDXL的基础尺寸。

后处理模块

后处理模块,是参考国外一个老哥的思路:

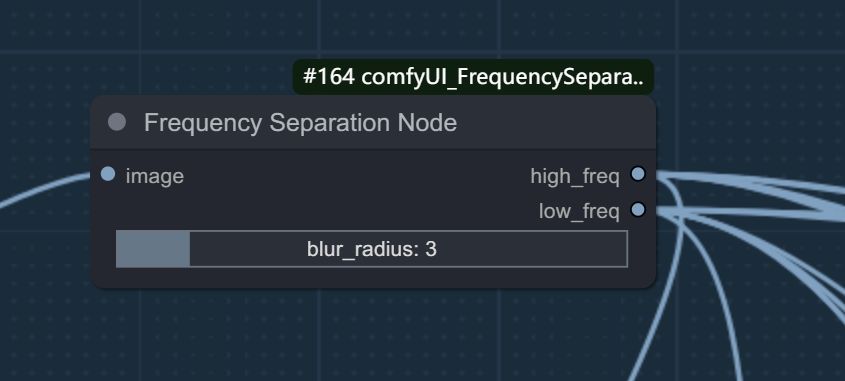

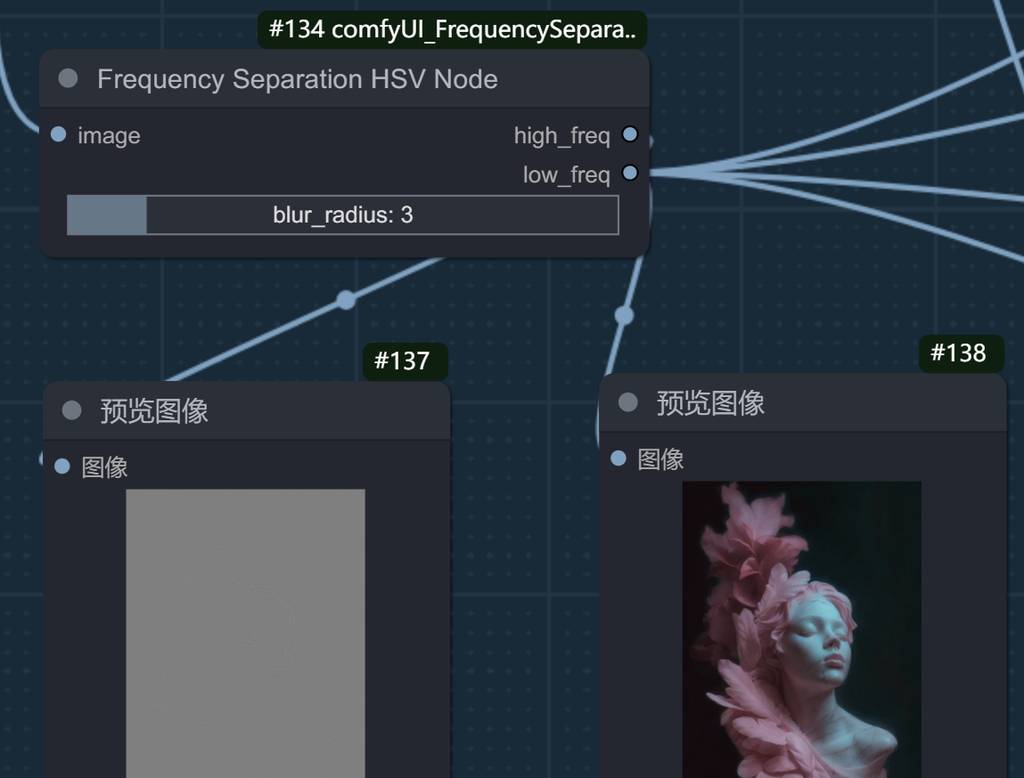

核心是使用类似PS的高低频分离,然后拼合图层,这样可以尽量保持高光和阴影关系,同时不会对中间调产生较大的影响。

将IC处理后的图片进行分离:

对原图进行分离。

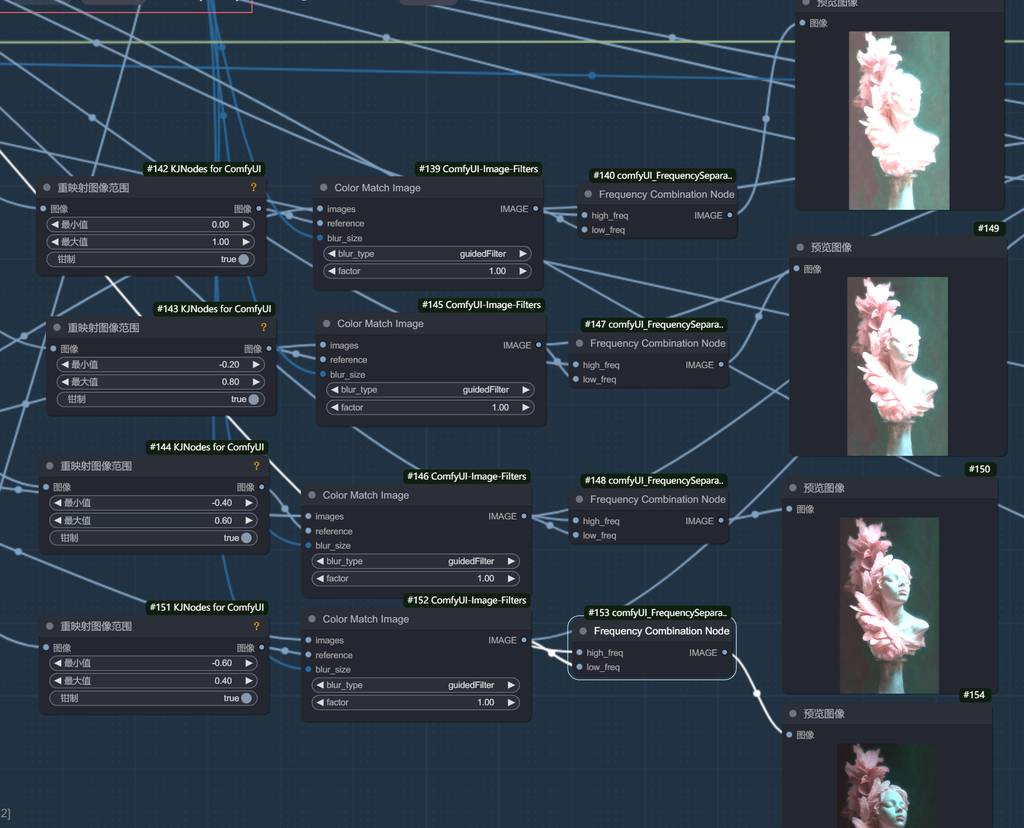

对分离的图进行两两合并。

通过这种方式,会把整体的调调分离出来,大致的光线关系有了,但还不够。

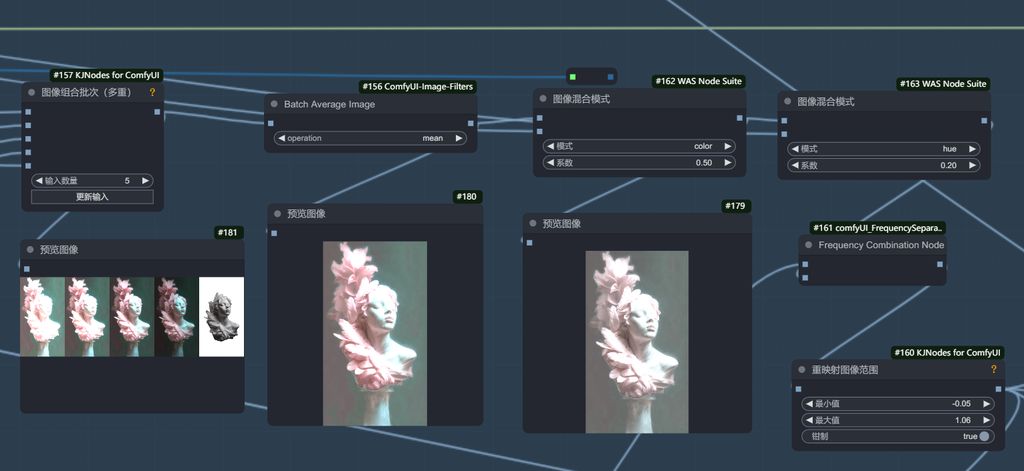

这里我改进了老外的流程,再做一次拼合,同时对颜色进行修正。

最后就可以出图了。

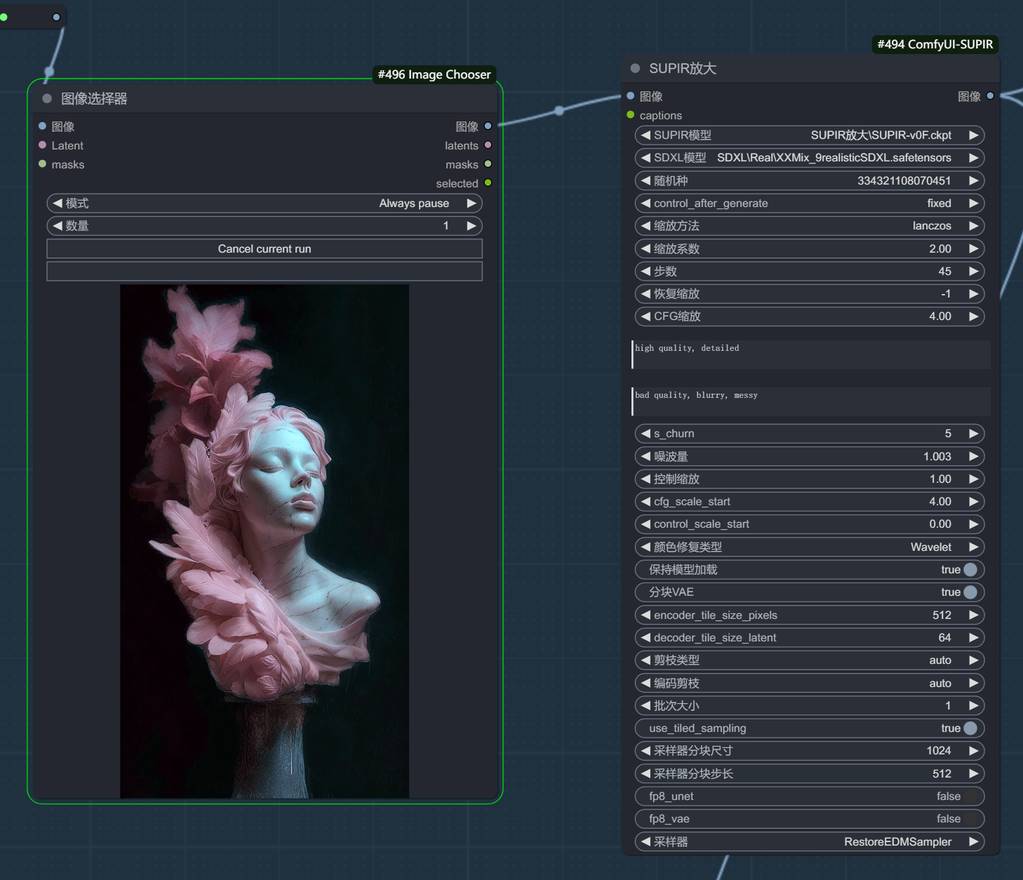

图片的分辨率是1024,如果需要放大,可以使用supir节点进行放大,相对无损。

大家都尝试做一个流程吧,一起追赶Magnific!

好了,关于的分享介绍就到这里,有什么疑问或者问题,可以留言交流哦~ 关注我公众号(设计小站):sjxz00,获取更多AI辅助设计和设计灵感趋势。